12月15日,欧盟网络与信息安全局(ENISA)发布了题为《人工智能的网络安全挑战:人工智能威胁图谱》(Artificial Intelligence Cybersecurity Challenges: Threat Landscape for Artificial Intelligence)的报告,报告对人工智能网络安全生态系统及威胁图谱进行了描述,还强调了人工智能安全的相关挑战。

文章仅供参考,观点不代表本机构立场。

ENISA发布人工智能网络安全威胁图谱

作者:学术plus高级评论员 张涛

1.简介

人工智能不断影响着我们的生活,并通过自动化决策能力在数字化转型中起着关键的作用。作为新兴技术,人工智能带来的优势是非常明显的,但同时也带来了潜在的风险。比如,人工智能技术在自动驾驶汽车、智慧医疗等安全关键领域的应用可能会给个人和企业带来新的、有可能不可预测的风险中,也可能会带来新的攻击方法和技术,并创建新的数据保护挑战。

要确保人工智能本身的安全,那么需要:了解要确保什么的安全;了解相关的数据治理模型;在多方参与的生态系统中以一种综合的方式管理威胁;开发特定的控制方式来确保人工智能本身是安全的。

人工智能和网络安全具有多维关系,并且具有一系列的相互依赖性。

人工智能的网络安全问题。人工智能模型和算法缺乏鲁棒性,存在安全漏洞,比如对抗模型干扰和操纵,针对人工智能赋能的空间物理系统的攻击、对人工智能系统使用的数据的攻击等。

人工智能赋能网络安全。人工智能作为一种工具,可以通过开发更有效的安全工具来创造更强的网络安全能力;并利用人工智能来帮助执法机构等更好地应对网络犯罪,比如大数据分析调查取证、人工智能在犯罪活动中的应用等。

人工智能的恶意使用。人工智能的恶意使用可以创建更复杂的攻击,比如人工智能用于恶意软件生成、高级社会工程、DDoS攻击、深度生成模型生成虚假数据、口令破解等。这类使用既包括针对现有人工智能系统的攻击,也包括人工智能应用于攻击活动中。

2.AI生命周期

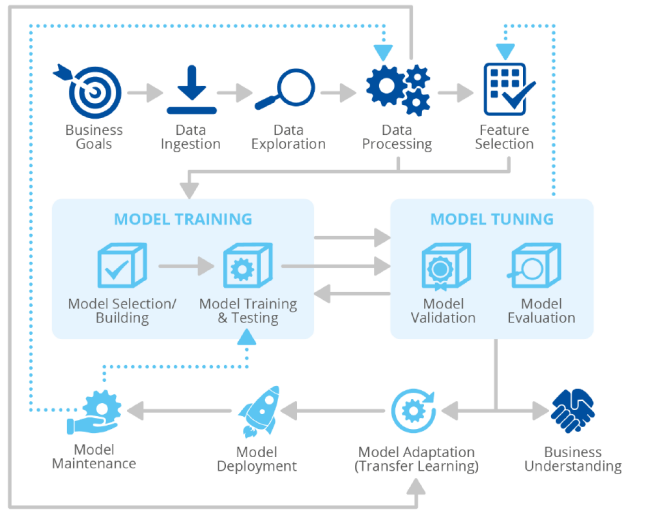

人工智能系统的生命周期包括几个相互依赖的阶段,从设计和开发(包括需求分析、数据收集、培训、测试、集成等子阶段)、安装、部署、操作、维护和处置。

图1 人工智能生命周期通用参考模型

2.1 数据

数据是人工智能中最有价值的资产之一,在人工智能生命周期中会不断地进行转化。图2是数据在人工智能生命周期内不同阶段的转化过程:数据引入(Data Ingestion)、数据探索(Data Exploration)、数据预处理(Data Pre-processing)、特征重要性(Feature Importance,类似特征提取)、培训、测试和评估(Training, Testing and Evaluation)。人工智能生命周期中的数据转换涉及其他几种类型的资产,如参与者、计算资源、软件等,甚至包括一些非有形资产,如流程、文化等,参与者的经验和知识可能带来潜在的非故意的威胁。

图2 人工智能生命周期开发阶段的数据转化过程

2.2 人工智能生命周期的参与者

在完整的人工智能生命周期中有不同类型的参与者,其中包括人工智能系统设计和创建工程中的人工智能设计者和人工智能应用开发者。此外,还有开发人工智能系统中所用的软件和算法的人工智能开发者。他们的经验和能力在安全的人工智能系统开发中起着非常重要的作用。

人工智能开发者和设计者的工作与数据科学家联系非常紧密。

数据科学家的工作包括帮助设计和开发人工智能模型。数据科学家还参与收集和翻译数据的工作,主要是从数据中提取知识和观点。

数据工程师主要是从不同的源中提取和收集数据,然后进行转化、清理、标准化并存储。数据工程师主要是对数据流进行设计、管理和优化。

人工智能生命周期中其他的主要参与者还包括数据所有者。数据所有者是用于训练或验证人工智能系统的数据集的所有者。数据所有者也可以是数据提供者或数据代理商。

人工智能生命周期的参与者还包括模型提供商,负责提供经过训练或调整的模型。其中一些模型提供商是云提供者,以模型即服务的形式提供模型。也有第三方的提供者向开发者提供用于训练人工智能系统的第三方框架和库。

最后是使用人工智能系统的终端用户,也就是服务的消费者。

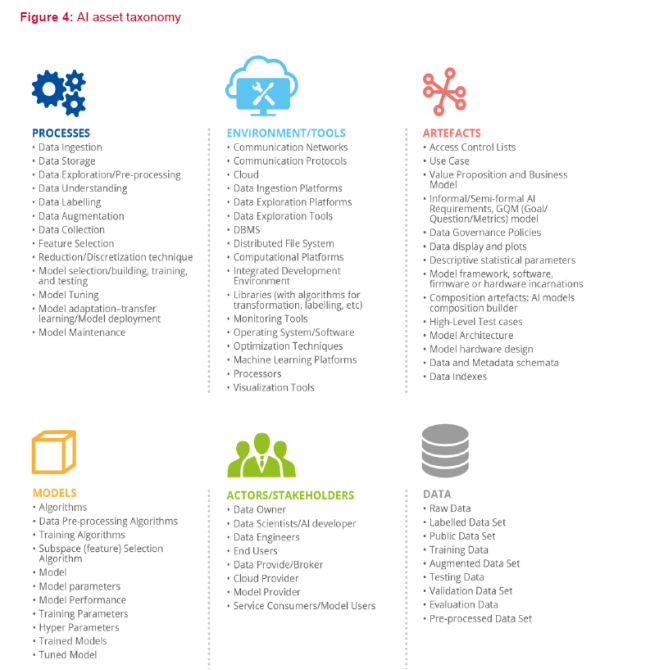

3. AI资产

威胁图谱中非常重要的一个元素就是可能暴露给威胁的资产种类。除了数据、软件、硬件、通信网络等与ICT相关的通用资产外,人工智能还有模型、数据等特定的资产,具体包括以下6大类:数据;模型;参与者;过程;环境/工具;相关产物Artefacts。

3.1 数据

数据资产包括原始数据、标记的数据集、公开数据集、训练数据、测试数据集、验证数据集、评估数据、预处理数据集等。

3.2 模型

模型资产包括算法、数据预处理算法、特征选择算法、模型、模型参数、模型性能、训练参数、超参数、训练后的模型、微调过的模型等。

3.3 参与者

参与者资产包括数据所有者、数据科学家、人工智能开发者、数据工程师、终端用户、数据提供者/代理人、云服务提供者、模型提供者、服务消费者/模型用户等。

3.4 过程

过程资产包括数据引入、数据存储、数据探索/预处理、数据理解、数据标记、数据收集、特征选择、模型选择/构建、训练和测试、模型微调、模型适应-迁移学习/模型部署、模型维护等。

3.5 环境/工具

环境/工具资产包括通信网络、通信协议、云、数据引入平台、数据探索平台、DBMS(数据库管理系统)、分布式文件系统、计算平台、集成开发环境、库、监控工具、操作系统/软件、优化技术、机器学习平台、处理器、可视化工具。

3.6 相关产物Artefacts

相关产物资产包括访问控制列表、用例、数据管理、价值主张和商业模型、数据管理策略、描述性统计参数、模型框架、软件、固件和硬件、高级测试用例、模型架构、模型已经按设计、数据和元数据方案、数据索引。

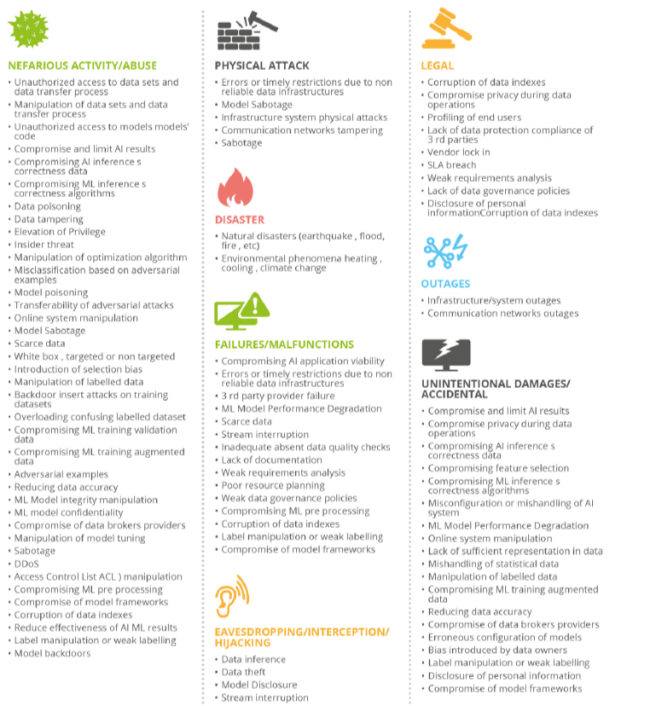

4. AI威胁

根据ENISA威胁分类方法,人工智能安全威胁主要可以分为以下几类:

恶意活动/滥用(NAA):指通过恶意行为,以窃取、更改或摧毁特定目标为目的,针对ICT系统、基础设施和网络的蓄意行为。

窃听/拦截/劫持(EIH):在未经用户同意的情况下监听、拦截或控制第三方通信的行为。

物理攻击(PA):旨在摧毁、暴露、更改、禁用、窃取或获得对基础设施、硬件或互联的物理资产的未经授权访问的行为。

非故意损害(UD):造成财产或人员的破坏、伤害或伤害,并导致失效或降低效用的无意行为。

故障或故障(FM):硬件或软件等资产部分或全部功能失效。

停机(OUT):服务意外中断或质量下降至要求水平以下。

灾害:造成重大损害或生命损失的突发事故或自然灾害。

法律(LEG):第三方根据法律采取的行动进行诉讼或赔偿损失。

4.1 恶意活动/滥用(NAA)

对数据集和数据转移过程的非授权访问;

对数据集和数据转移过程的操作;

对模型代码的非授权访问;

入侵和限制人工智能结果;

入侵人工智能干扰正确的数据;

入侵机器学习干扰正确的数据;

数据投毒;

数据修改;

权限提升;

内部威胁;

优化算法的操作;

基于对抗样本的错误分类;

模型投毒;

对抗攻击的转移;

在线系统操纵;

白盒、定向或非定向攻击;

标记数据操纵;

针对训练数据集的后门插入攻击;

入侵机器学习训练验证数据;

对抗样本;

降低数据准确率;

机器学习模型完整性操纵;

DDoS攻击;

入侵机器学习预处理;

入侵模型框架;

数据索引破坏;

降低人工智能机器学习结果的有效性;

模型后门。

4.2 窃听/拦截/劫持(EIH)

数据干扰;

数据窃取;

模型泄露;

弱加密。

4.3 物理攻击(PA)

由于不可靠数据基础设施引发的错误或限制;

模型破坏;

针对基础设施系统的物理攻击;

通信网络攻击;

其他蓄意破坏。

4.4 非故意损害(UD)

入侵或限制人工智能结果;

在数据操作过程中破坏隐私;

破坏特征选择;

人工智能系统的操作配置或错误处理;

机器学习模型性能降级;

在线系统操纵;

数据缺乏充分的表示;

统计数据错误处理;

降低数据准确率;

模型的错误配置;

数据所有者引入的偏见;

个人信息泄露;

模型框架破坏。

4.5 故障(FM)

由于不可靠数据基础设施引发的错误;

第三方提供商故障;

机器学习模型性能降级;

数据质量检查缺失;

弱需求分析;

资源规划不足;

弱数据管理策略;

数据索引破坏;

入侵机器学习预处理;

入侵模型框架。

4.6 停机(OUT)

基础设置/系统停机;

通信网络停机。

4.7 灾害

地震、洪水、火灾等自然灾害;

气候变化等。

4.8 法律(LEG)

数据索引破坏;

厂商锁定;

弱需求分析;

缺乏数据治理策略;

个人信息泄露。

5.结论

ENISA人工智能威胁图谱是即将发布的网络安全政策倡议和技术指导的基础,还介绍了人工智能相关的挑战。其中一个特别重要的领域是与人工智能相关的供应链。因此,强调包括人工智能供应链的所有要素在内的欧盟生态系统对安全可靠人工智能是非常重要的。欧盟的安全人工智能生态系统应将网络安全和数据保护放在首位,并促进相关的创新、能力建设、提高认识和开展研发活动。

声明:本文来自学术plus,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。