原文标题:On the Security Risks of AutoML

原文作者:Ren Pang and Zhaohan Xi, Pennsylvania State University; Shouling Ji, Zhejiang University; Xiapu Luo, Hong Kong Polytechnic University; Ting Wang, Pennsylvania State University

发表会议:USENIX SECURITY "22

原文连接:https://www.usenix.org/system/files/sec22summer_pang.pdf

笔记作者:Norns@SecQuan

笔记小编: ourren@SecQuan

0x01 Introduction

自动机器学习(AutoML)是自动构建机器学习模型,减少人力在机器学习模型构建中的参与的一种重要方法。神经网络结构搜索(Neural Architecture Search, NAS)是AutoML的一种,目的是针对具体的任务,搭建最合适的神经网络模型。随着NAS在越来越多重要任务上的应用,对NAS搭建出来的模型的安全性评估成为了一个亟待解决的问题,这篇文章的提出,弥补了这一研究上的空白。

针对NAS搭建出来神经网络模型,作者关注以下三个问题:

相较于人工搭建的神经网络模型,NAS构建的模型是否会更加的脆弱?

如果对于第一个问题的回答是肯定的,那么是什么原因导致了这一脆弱性?

如何避免NAS给神经网络模型带来的脆弱性?

0x02 Measurement

为了回答上述提到的第一个问题,作者选用若干NAS构建的和人工构建的神经网络模型,用不同数据集进行验证,探究NAS构建的神经网络模型是否会更加的脆弱。

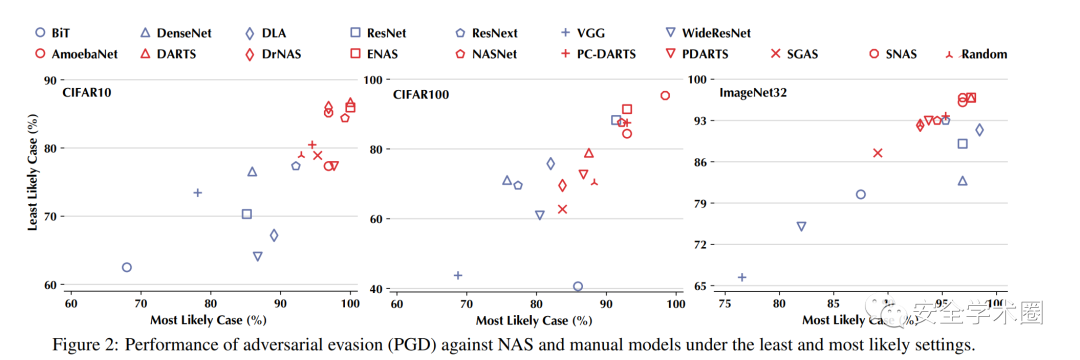

以PDG攻击(projected gredient descent attack)为例,作者评估不同的模型受到攻击时攻击的成功率。实验的结果如下图,其中红色表示NAS构建的模型,蓝色表示人工构建的模型。

根据实验结果,可以得到几个结论:

NAS构建模型受到攻击时攻击的成功率较高。

相较于人工构建的模型,NAS构建的模型在分布在更加密集,表示它们的脆弱程度具有某种相似性。

NAS构建的模型的脆弱性在不同的数据集上的表现出了不同的模式。

可以看出,NAS构建的模型相较于人工构建的模型更容易遭受攻击,且NAS构建的模型在脆弱性上具有某种相似性。在其它针对神经网络模型的攻击上可以得到相似的结论。

0x03 Analysis

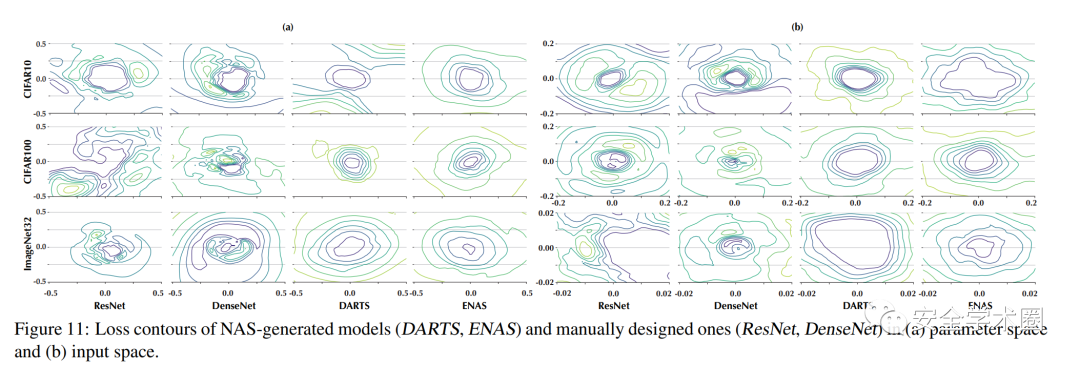

作者提出假说:流行的NAS方法通常在备选模型还没收敛时就对其进行评估,因此NAS倾向于选择那些收敛速度快的模型。根据这个假说,NAS构建的模型应该具有以下两个特点。

High loss smoothness:梯度是神经网络进行优化是的重要依据,由于NAS趋向于选择收敛快的模型,这些被选择的模型的Loss Landscape都更加的平滑。

Low gredient variance:NAS模型的梯度相对于给定的分布倾向于有较低的方差。因此,随机梯度作为真实梯度的估计,使NAS模型收敛更快。

对神经网络模型攻击的成功率高度依赖于Loss Landscape的平滑性和梯度的方差,基于以上原因,NAS遭受攻击时攻击的成功率较高。

0x04 Potential Mitigation

对NAS模型进行保护的策略包含两种:(1)在NAS模型生成后应用保护措施;(2)使用更为安全的方式生成NAS模型。

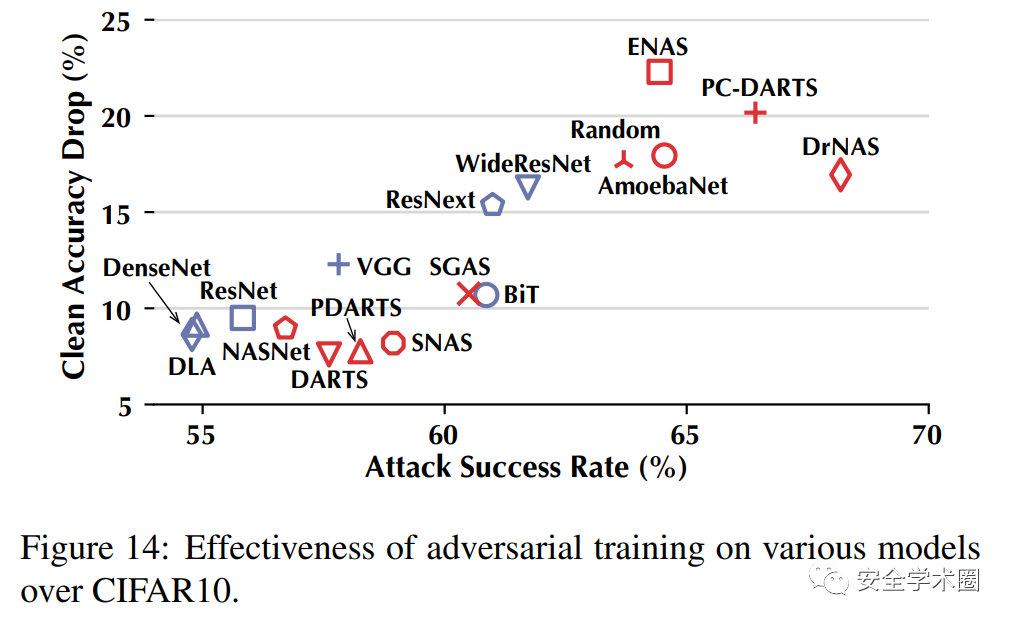

Post-NAS mitigation

以对抗训练为例:

实验结果表明,在对NAS模型应用保护措施能够有效地降低模型的脆弱性。

In-NAS mitigation

作者对NAS模型的生成机制提出了两点建议:(1)增加单元的深度;(2)尽量不要添加跨层的连接。仅仅做到这两点,就能够有效地降低NAS模型的脆弱性。

安全学术圈招募队友-ing, 有兴趣加入学术圈的请联系secdr#qq.com

声明:本文来自安全学术圈,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。