当前关于算法战的讨论已经很多,但多关注算法战的颠覆性作用,对于其存在的弱点和缺陷的深入讨论暂付阙如。特别是,算法系统固有的“黑箱”等问题是算法战挥之不去的“阿喀琉斯之踵”,如日益复杂的算法系统不可避免地存在算法逻辑不当等安全漏洞,极有可能会造成系统瘫痪等致命后果。可见,寻求破解算法战的“阿喀琉斯之踵”的解决方案,制定合乎战争逻辑的算法开发与应用准则,是发挥算法战争效能的关键所在。

算法——算法战的灵魂

算法系统是算法战的核心。算法系统具有三大要素:数据、算法、算力,其中数据是基础,算力是保障,算法是算法系统的“大脑”。而算法战的本质就是在数据与算力的支撑下,将算法应用于战争,发挥算法在战场态势感知、情报融合分析、指挥辅助决策和火力引导打击等方面的自动化优势,从而节约人力成本、降低战争迷雾、创新作战样式、加快战争节奏。

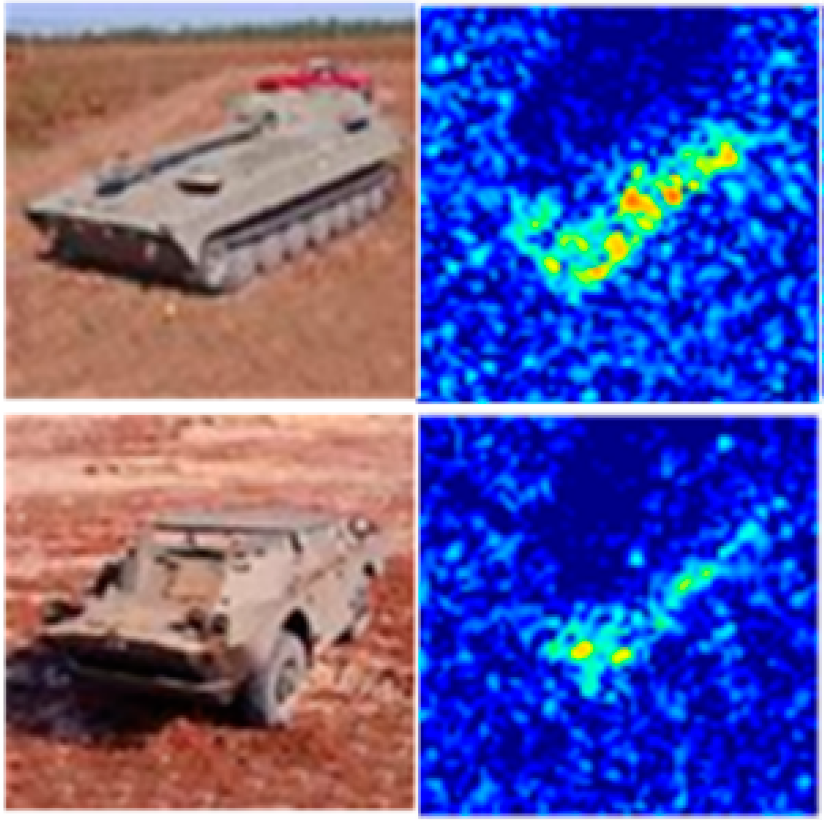

节约人力成本,提高数据分析自动化程度。算法能够将数据分析专家从机械重复的判读任务中解放出来,从而能够节约大量人力成本,聚焦于更高层级的数据分析任务。以图像识别技术为例,20世纪图像侦察刚投入战场应用之时,军事目标图像识别完全依赖专家人工判读,此后出现的基于专家先验知识的自动目标识别算法,仍需专家根据传感器、军事目标等特性,针对性设计目标特征提取算法,如窄带雷达常使用基于时域的小波变换算法进行目标特征建模。现如今基于深度学习技术的图像识别算法,可以自主学习目标特征,无需人工干预,目标识别准确率甚至比专家还高,如下图所示的两幅图像,源自于美国DARPA公开发布的前苏联地面军事目标SAR图像数据集MSTAR,分别为2S1(自行榴弹炮)与BDRM-2(装甲侦察车),肉眼不仅难以分辨两者,还需耗费大量人力精力,而运用基于深度学习算法,识别准确率可超过99.5%。洛克希勒·马丁公司2020年发布的卫星图像识别系统GATR,使用开源数据集进行自我训练,可以快速识别船只、飞机、建筑物、海港等军民用目标,识别准确率可超过90%。

2S1(上)与BDRM-2(下)光学图像(左)与SAR图像(右)对比

降低战争迷雾,提升战场态势感知能力。过去只有人脑才能实现的军事知识关联、目标意图推理、战场环境仿真、态势趋势推演等任务,算法也可将逐步实现甚至表现更为优越,能够挖掘常人容易忽略的局部信息或者难以逻辑的全局信息,辅助指挥员看得清战场、定得准态势、判得远方向,降低战争迷雾。DARPA 2007年启动的深绿项目,便能够提前演示不同作战方案可能产生的各种结果,协助指挥员对敌方行动进行预判。2018年DARPA战略技术办公室发布的指南针项目,也可帮助作战人员通过衡量对手对各种刺激手段的反应来识别对手意图。

创新作战样式,达成“一招制敌”效果。算法技术进步也会带来作战样式多样化,可据此研究创造全新的战术战法,让对手防不胜防,达成“一招制敌”效果。2019年美陆军曾成功演示了一枚由灰鹰无人机发射的小型精确滑翔炸弹,在到达目标的前一秒,基于机器学习的算法系统,自动检测到了一个更高威胁的目标,算法系统迅速重新制导,并在几秒钟内将之摧毁,若全采用“人在回路”制导模式,较难实现上述作战过程。同样地,早期鱼雷等制导武器,受限于传感器、算力、算法技术受限等因素,主要采用“人在回路”制导模式,单人单批次可操控弹药数量受限,现如今随着制导算法进步,基于“发射后不管”的制导模式,射手可采用饱和攻击模式,且能较好识别诱饵假目标。

各国高度重视算法的军事应用

加快战争节奏,创造“以快制胜”的先发优势。随着算法进步与自动化程度提高,OODA周期时间不断缩短,信息流转、融合速度不断提高,作战节奏不断加快。算法先进的军队,态势感知、情报分析、指挥决策、作战行动的能力更强、速度更快、精度更高,将在以分秒计算的未来战场中创造“以快制胜”的先发优势,算法落后的对手将陷入处处被动的局面。如2008年洛克希勒·马丁公司为美国导弹防御局演示的多杀伤运载器交战管理算法,旨在利用复杂算法整合自身探测系统与导弹防御系统信息,压缩前期目标信息需求,极大地压缩交战时间,加快作战节奏。

当前算法战存在的

“阿喀琉斯之踵”

即便算法战将在未来战争中大放异彩,但毋庸置疑,算法固有的“黑箱”等问题始终制约着算法最大化发挥其战争效能。

可解释性难题 对使用算法系统的作战人员而言,算法系统的数据输入层与数据输出层之间是不可观测的“黑箱”空间,也就是说他们并不理解算法系统如何推理运算,也不知道系统作出决策的依据,作战人员也就难以对其产生信任,极有可能“弃之不用”。但即便是算法开发人员,也不尽理解底层算法逻辑,现行人工智能算法较多地依赖工程经验调整算法参数权值,缺乏基础理论支撑,算法决策结果不可预知。2007年,美军第3机步师的3台利剑机器人,由于算法逻辑错误,其中1台机器人在执行任务时竟完全失控,将枪口瞄准了操作员,其决策结果并不符合预期效果。一旦发生误伤事件,究竟是追究算法研发人员责任,还是作战指挥员等责任,难以判定。如果算法可解释性难题最终无法解决,也就意味着无法理清致命性自主无人武器平台的战争责任,也就无法投入战场应用。

鲁棒性难题 以军事目标图像识别技术为例,受各种客观因素限制,平时或战时可采集的对手军事目标图像的样本少、角度少、距离远、目标小,如卫星侦察图像多为高仰角数据,而巡航导弹末制导前迎角较低,目标特征并不一致。使用“脏数据”较多,泛化程度不高的数据,算法模型易出现“过度拟合”等问题,难以达到预期效果。算法研发基于理想的环境模型,即使经过多次测试调整,也难以拟合瞬息万变的实战环境,算法能否在严苛的实战环境下仍然保持预期运行效果,是确保其能否发挥最大作战效能的关键所在。

美国“灰鹰”无人机

安全性难题 功能系统越复杂,安全管理难度越高。如在军用平台已投入广泛使用的语音识别算法系统,其普遍使用的麦克风硬件拾音频率上限约为24kHz,超出了人类可识别声音频率上限(20kHz),设备可正常接收,而听众无法察觉。攻击者便可使用该频率发送声音攻击语音识别算法系统,同理,也可利用生成人类肉眼难以察觉的“毒”像素点,干扰算法输出结果。其次,随着代码规模提高,算法也不可避免地出现代码漏洞等安全问题,如人工智能算法常用的Caffe框架,使用了超过130组的基础代码库和第三方代码组件支持,2018年曾被发现了数十种严重的代码漏洞。而军用平台代码更新速度慢或者不更新,这使得算法战平台容易成为被攻击对象。

如何破解算法战的

“阿喀琉斯之踵”?

从系统工程角度来看,算法战的弱点主要是因为算法本身固有的特性导致的,完全破解这一“阿喀琉斯之踵”既不可能,也不现实。尽管算法已经大量投入到军事应用中,但应该看到,人力仍然是绝大多数军用场景,诸如情报分析等任务的主力要素,自动化算法并未完全取代也将难以完全取代机械人力。可见,算法的军事应用,乃至于算法战的概念仍在雏形中,相应的约束规则也根据算法战的发展阶段进行适时探索调整,否则会令技术发展停滞不前。从另一个角度看,“阿喀琉斯之踵”的存在会一直促使算法理论基础与技术应用的发展进步。要破解算法战存在的“软肋”,可从以下几个方面进行探索。

制定以用户为导向的可解释标准。要求算法系统对一切军用场景与一切结果皆可解释过于严苛,姑且不论算法决策是否完全理性,指挥员本身就是非理性决策体,双方建立信任关系并不完全依靠算法可解释性,如算法决策结果准确率超过指挥员心理阈值后,便可能建立起信任关系,在此过程中指挥员可能并不关心“黑箱”的算法决策过程。从用户的角度来看,作战人员会用脚进行投票,对能够理解的算法持久信任并产生使用需求,开发人员也会主动提高其可解释程度以提高采纳率,这在战场上是至关重要的,如在争分夺秒的指挥决策时,指挥员可独立思考并筛选最优的算法决策,而不需要时间成本可能极高的可解释结果。因此只有对用户可解释,算法系统才会发挥其最大效能。

导弹双发齐射可提高命中率与效费比

制定以经济可行性为导向的鲁棒性标准。将一枚精确制导导弹的命中概率从90%提高到99%,所需付出的成本可能是指数级增长的,但采用“双发齐射”的打击战术,命中概率便能达到99%,成本也相对较低。可见,对算法系统的鲁棒性要求要综合衡量技术与经济可行性,完全拟合真实战场环境并不现实,更可能导致算法系统过于臃肿而可用性降低,成本也十分高昂,同时在算力不足的终端作战平台,也不具备技术可行性。在效费比过低的情况下,可采用更加经济高效的战术战法创新方法弥补鲁棒性不足的缺陷。因此,需综合衡量技术与精力可行性制定算法的鲁棒性标准。

制定以风险为导向的安全性标准。算法不是越透明越好,也不是越安全越好。例如,最安全的地面车辆可能为坦克,但普通家庭用户更倾向选择购买舒适性与便利性更优异的汽车。对于后方独立运行的情报分析算法,与一线作战的致命性指挥决策算法,就需要区别对待,如果一刀切地要求最高安全标准,缺乏合理性和必要性。所以欧盟的人工智能法草案按照应用场景的不同将人工智能系统分为高风险、有限风险和最小风险,算法的安全标准也需区分风险制定,如分级分类别制定标准,如将直接致命的算法系统列为高风险,需具备最高程度的可解释性、鲁棒性、安全性标准,始终确保作战人员拥有最高开火权限,在算法不可用的恶劣场景中,甚至需要自毁以确保其不会造成严重后果。

版权声明:本文刊于2022年11期《军事文摘》杂志,作者:王聃锋、庞钢明,如需转载请务必注明“转自《军事文摘》”。

声明:本文来自军事文摘,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。