随着人工智能技术的飞速发展,一种名为"AI视频换脸"的技术近年来引起了广泛的关注。然而,伴随着技术的发展,技术也面临着滥用的风险。最近爆发了一系列AI换脸视频引发的诈骗案件,背后涉及到大量关于数据、个人信息和生物识别信息的问题。犯罪分子利用换脸技术,将受害者的面部特征"粘贴"到其他人的面部上,以此进行诈骗。这种技术的滥用不仅侵犯了个人隐私和财产利益,也对社会的安全稳定构成了威胁。因此,我们有必要深入理解AI视频换脸的技术原理,同时从技术角度探索有效的甄别策略。

01 AI视频换脸技术原理分析

AI要将一段视频中的人脸更换为另外一个人的,简单来的说就是识别、替换、融合渲染3个步骤。

1、识别

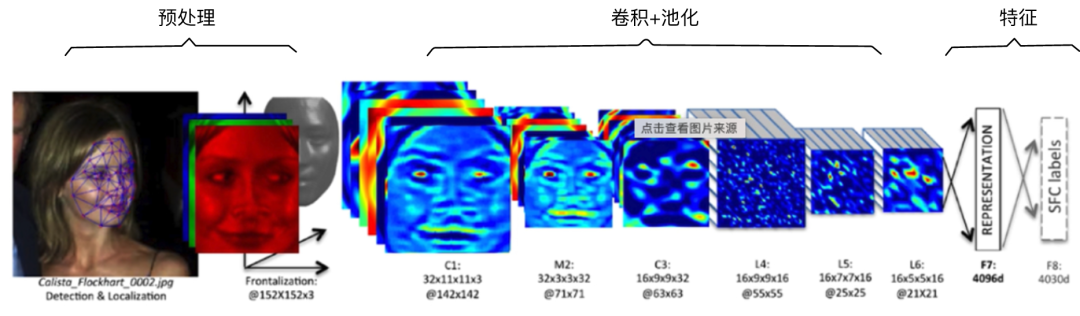

AI人脸识别的方法主要采用的是深度学习中的卷积神经网络(Convolutional Neural Network, CNN)。卷积神经网络在人脸识别中的应用主要通过以下四个步骤进行:

预处理:人脸图像首先需要进行预处理,包括调整图像的尺寸、归一化亮度和颜色等,减少图像的内在差异和环境影响,为CNN的输入提供统一的格式。

卷积层:预处理后的图像被送入CNN的卷积层。卷积层利用小型的卷积核在图像上进行滑动,实现局部特征的提取,如边缘、角点等,这些特征形成了人脸的基本构造。

池化层:卷积后的特征图会进入池化层。池化层主要用来降低数据的维度,减少计算量,并且可以提升模型的鲁棒性,防止过拟合。同时,通过不同的池化方式,可以保留重要的特征信息。

全连接层:经过一系列的卷积和池化操作后,得到的特征图会送入全连接层。全连接层将这些特征图进行扁平化处理,得到一个特征向量。这个向量包含了输入图像的高级特征,能够用于区分不同的人脸。在训练阶段,模型会学习这些特征与标签的关联,使得在测试阶段,模型能够根据输入的人脸图像输出相应的识别结果。

通过这四个步骤,卷积神经网络可以从原始的人脸图像中提取出关键特征,进行高效准确的人脸识别。

为了方便理解,我们把卷积神经网络人脸识别的过程,比作警察办案的过程。

预处理阶段:就像开始调查之前首先需要了解案件的背景和基本信息。这可能包括案发地点、时间、相关人员等。对图像进行预处理,比如调整大小、亮度、对比度等,就像获取和整理案件的基本信息,为后续的调查做准备。

卷积层:可以看作开始深入调查案件,寻找线索,这些线索可能包括指纹、脚印、证人证言等。这就像卷积层通过应用滤波器对图像进行卷积操作,提取出图像的特征,例如人脸的眼睛、鼻子、嘴巴等部位的形状和位置。

池化层:可以看作收集了大量线索后,需要筛选出最重要的线索,排除干扰。这就像池化层将卷积层产生的特征图进行降采样,保留最显著的特征,丢弃不太重要的信息。

全连接层:就像是总结报告,构建案件的全貌会将所有的证据进行整合,寻找真凶。全连接层就像这个过程,将所有重要特征连接在一起,生成一份能够表示原始人脸图像的特征向量。

因此,通过这一系列的步骤,CNN就像一个专业的警察,能够从复杂的人脸图像中提取出关键的特征,用于识别不同的人脸。

2、替换

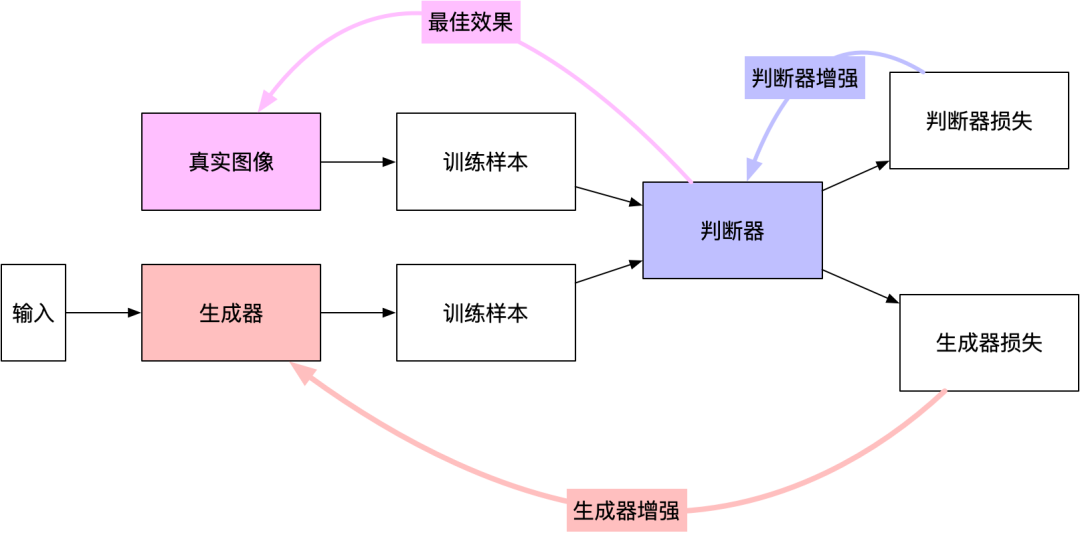

要将一个人的人脸替换到视频中,那需要另外一种深度学习技术了,叫做生成对抗网络(GANs)—— 这是一种可以生成极其逼真的人脸照片的技术。生成对抗网络结构概览如下:

GANs由两部分组成,一部分是生成器,一部分是判断器。

生成器:生成器的目标是产生逼真的图像,即尝试生成与真实人脸非常相似的人脸图像。在人脸替换任务中,生成器通常接受一个源人脸图像和一个目标人脸的身份信息作为输入,输出一个合成的人脸图像,其中人脸的身份与目标人脸相同,而其他表情、姿态等信息与源人脸图像相同。

判断器:判断器的任务故名事宜是用来判断输入的图像是生成器生成的假图像,还是真实的图像。在训练过程中,判断器会同时接收来自生成器的合成图像和真实的人脸图像,并尝试判断它们的真伪。

就这样,生成器和判别器就形成了一个博弈的过程,会在训练过程中不断地博弈,生成器尝试生成更逼真的图像以骗过判别器,而判别器则尝试提高其区分真伪图像的能力。通过这种博弈,生成器能够逐渐提高其生成图像的质量,使得人脸替换的效果更逼真。

3、融合渲染

融合渲染在这里表达的是一个比较广泛的概念,包含了人脸跟踪、人脸对齐、环境融合、视频渲染最后是成果输出。

人脸跟踪:使用跟踪算法,识别出视频中每一帧中的人脸的位置,并跟踪人脸在不同帧之间的运动。

对齐融合:替换后的人脸需要与原始视频中的人脸进行对齐和融合,以确保在视觉上无缝地替换。这通常涉及到人脸对齐算法,将合成人脸与原始人脸的姿态和表情进行匹配,并使用图像处理技术进行融合,使得替换的人脸与周围环境更加一致。

视频渲染:将经过替换和融合处理的视频帧进行渲染,生成最终的替换结果。这可能涉及图像处理、光照调整和渲染技术,以确保最终的视频输出具有良好的视觉质量和连续性。

因此,对视频进行渲染是人脸替换过程中的一个重要步骤,以确保生成的合成人脸与原始视频的风格和特征相匹配,并呈现自然、连续的效果。

02 基于核心逻辑,提出甄别策略

我们将AI对视频进行换脸的识别、替换、融合渲染3个步骤进行了分析和梳理。我们可以发现,3个步骤中有一个重要的、共同的需求点,那就是“算力”。每一个步骤都需要使用到大量的计算,哪怕已经使用算力建立好了模型,也还是需要大量的计算,才能实现将视频中的人脸进行替换的目的。

换脸视频要达到完全以假乱真的效果,需要大量的、复杂的运算,就需要投入大量的资源在算力上。不法分子也不会无限制地投入算力,当算力出现短缺或不足的时候就只能牺牲效果(真实性)。就好比,我们要看蓝光超高清的电影,就需要更高的带宽,当我们带宽有限的情况下,我们就只能牺牲电影清晰度选择标清的电影了。经过分析。我们可以观察视频的这3个细节点,来判定视频中的人脸是否经过了换脸操作,这3个细节点都是需要大量算力才能满足要求的:

1、视频稳定性:在一个真实的视频中,人脸通常会保持相对稳定的位置和角度,运动的时候人脸的相对位置也会保持稳定。如果视频中的人脸出现多次、细微的位置、角度或大小的突变,可能表明进行了换脸操作。

2、人脸关键点一致性:利用人脸关键点信息,例如眼睛、鼻子、嘴巴、脸的边缘等位置。对于真实的视频,人脸关键点的位置应该在一定范围内保持一致。如果视频中的人脸关键点位置在不同帧之间发生了剧烈变化,可能意味着进行了换脸操作。

3、光线一致性:光线是一个重要的特征,对人脸的真实感有着非常重要影响。如果视频中的人脸在不同帧之间的光照条件出现了明显的不一致,可能是换脸的迹象。

总之,当视频中人脸关键点信息出现变化的那一刻(比如被挡上的人脸重新进入视线),会导致算法重新对人脸信息的识别和计算,提取到特征信息后(出现网格图像),然后才能进行换脸,这时候就会出现一定的“延迟”或“不协调感”,还是有可能被识破。因此,在视频过程中,可以通过让对方“回头”“开灯”“擦摄像头(挡住脸)”等改变环境方式来验证是否有被换脸,但是这仅限于恶意人员算力有限的情况下,如果算力不断增加,这种延迟会更难被察觉。重新提取特征信息的延迟演示如下:

03 小结

AI技术是一把双刃剑。它的发展给我们带来了巨大的潜力和机遇,但同时也伴随着一些潜在的挑战和风险。我们需要在技术、法律和社会三个层面上进行综合施策,以防止AI换脸技术的滥用。在技术层面上,我们需要开发出能够识别和防止深度伪造的新技术;在法律层面上,我们需要有明确的法律规定和管制措施,对于滥用这种技术的行为进行打击;在社会层面上,我们需要通过公众科普教育来增强公众的防范意识和能力。

(本文作者:北京汉华飞天信安科技有限公司 彭根)

声明:本文来自CCIA数据安全工作委员会,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。