导读 知识图谱和大型语言模型都是用来表示和处理知识的手段。大模型补足了理解语言的能力,知识图谱则丰富了表示知识的方式,两者的深度结合必将为人工智能提供更为全面、可靠、可控的知识处理方法。在这一背景下,OpenKG组织“新KG”视点系列文章——“大模型专辑”,不定期邀请业内专家对知识图谱与大模型的融合之道展开深入探讨。本期刊登浙江大学计算机科学与技术学院陈华钧教授分享的“大模型时代的知识处理:新机遇与新挑战”,本文整理自陈华钧教授在CCF Talk及在第三届知识图谱产业论坛上的主旨报告,精简版发表于中国计算机学会通讯CCCF第 19 卷第 9 期。

文章目录

1. 语言vs知识

1.1 ChatGPT:世界知识的神经网络化

1.2 知识图谱和大型语言模型都是处理知识的手段

1.3 世界(知识)模型 vs(语言)推理机器

2. 大模型技术栈中的知识图谱

2.1 知识增强与结构增强

2.2 提示工程即知识工程

2.3 知识图谱与思维链结构化

2.4 知识图谱与指令精调

2.5 大模型的知识编辑与知识对齐

2.6 知识图谱与工具调用及Al智能体

3. 知识图谱技术栈中的大模型

3.1 ChatGPT的自动化图谱构建能力

3.2 知识抽取大模型

3.3 结构化知识大模型

3.4 大模型增强的知识图谱推理

3.5 自动化本体与概念抽象

4. 总结与展望

文章作者 | 陈华钧 浙江大学计算机科学与技术学院教授/博导、OpenKG发起人

笔记整理 | 邓鸿杰(OpenKG)

01 语言 VS 知识

1.1 ChatGPT:世界知识的神经网络化

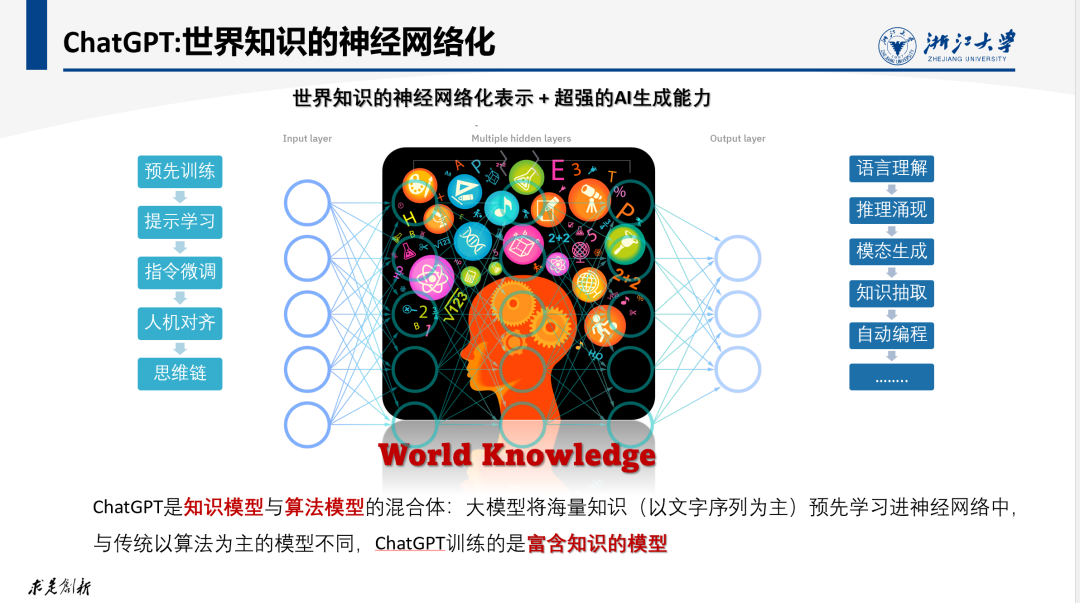

人们在认识世界的过程中不断积累关于世界的知识,而语言则是表示世界知识的最直接载体。目前为止,人类的绝大部分知识都是通过自然语言来描述、记录和传承的。除了记录常识知识的自然语言,人类还发明了描述数学模型的数学语言,描述分子结构的化学语言(如SMILE),描述生命体组成的基因语言等来表示和记录更为专业的专家知识。

以ChatGPT为代表大型语言模型将这种海量的、以序列为主的世界知识预先学习进神经网络中,并实现在参数化空间对知识进行处理和操作。与传统以算法为主的模型不同,ChatGPT训练的是富含知识的模型,是知识模型与算法模型的混合体。

1.2 知识图谱和大型语言模型都是处理知识的手段

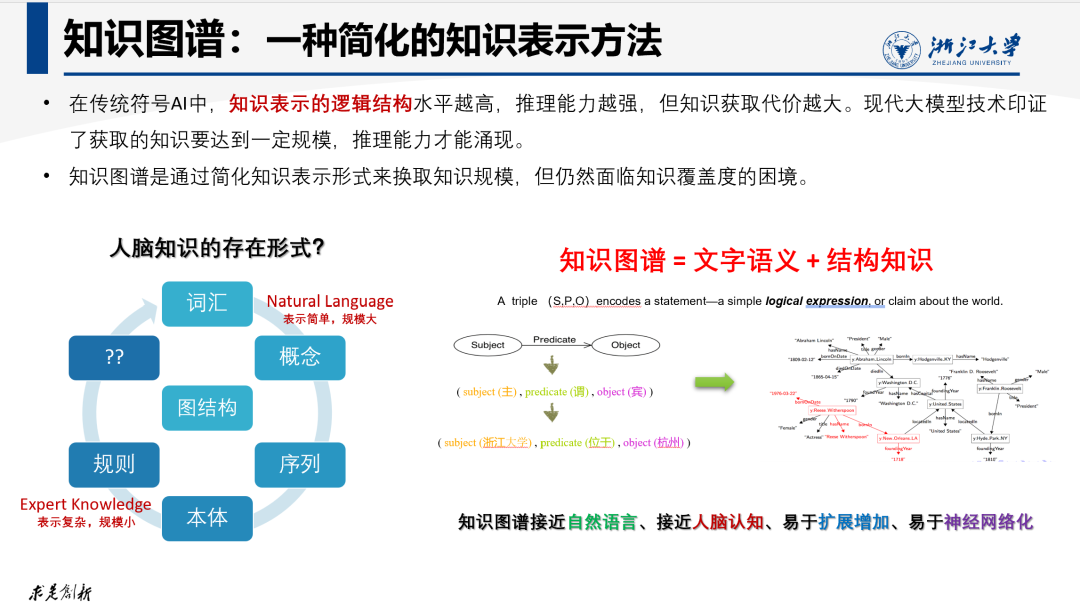

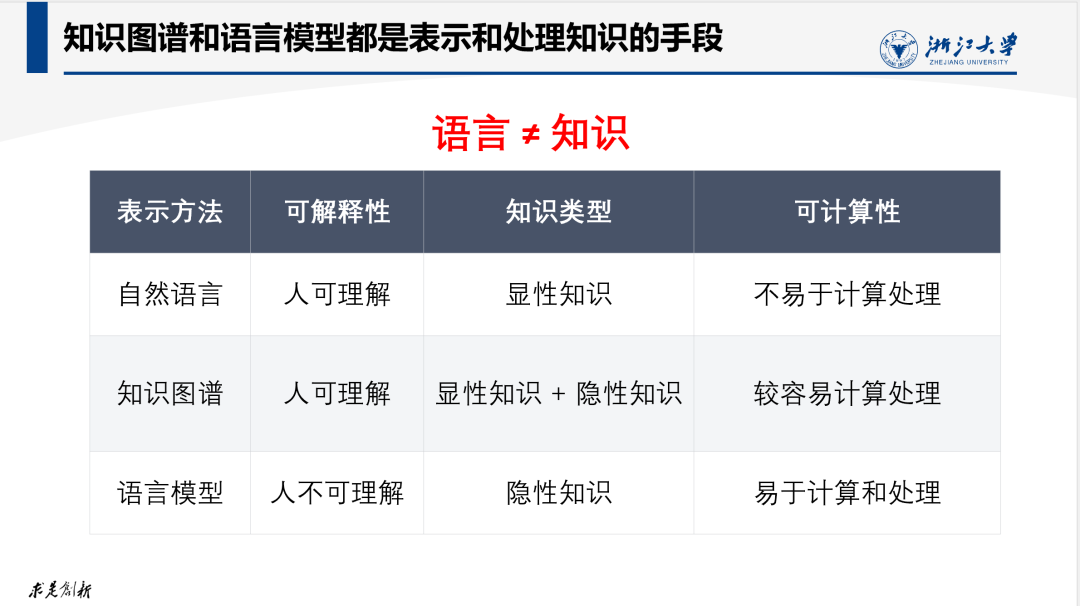

自然语言以文字序列的方式来表示知识,而知识图谱(KG)利用图结构来描述世界万物之间的关系,代表一类结构化的知识表示方法。典型结构表示包括:层次结构(如概念图谱)、关联结构(实体关系图谱)、时序结构(如事理图谱)、逻辑结构(如逻辑规则)等。知识图谱中既包含自然的文字语义,也包含结构化关联关系。

但人脑中的知识显然没有文字序列和图结构那么简单。在传统符号AI的研究中,知识表示的逻辑结构与推理机的推理能力有着密切的关系。简单的词汇或概念组成的自然语言序列通常被认为不利于机器进行推理计算,而具有层次结构的Taxonomy、更为复杂的本体结构Ontology以及规则逻辑则更加利于实现可靠的机器推理。正如后文分析,即使在基于文本预训练实现的大模型推理时代,这种知识表示的结构化水平与模型推理能力之间的正关联关系是仍然存在的。

自然语言和知识图谱是一种显式的知识表示方法,人可理解,可解释性好。随着神经网络与知识图谱的不断融合,研究人员进一步发展出知识图谱嵌入、图表示学习和预训练等向量化、数值化或参数化的隐性知识表示方法。大型语言模型(LLM)利用神经网络从超大规模的文字语料中学习文字的组合、交互和涌现规律,实现在神经网络参数空间编码基本的文字语义。进一步通过提示工程向模型注入更多人类先验知识;利用指令精调来扩展模型的任务泛化和知识外推能力,使得模型更容易适配到新的知识领域;再利用人机对齐学习来进一步调节模型行为,使得模型更加遵循人类指令和符合人类价值预期。与自然语言和知识图谱不同,LLM是完全参数化、数值化的知识表示方法,对人不可理解,但更益于机器学习和计算。

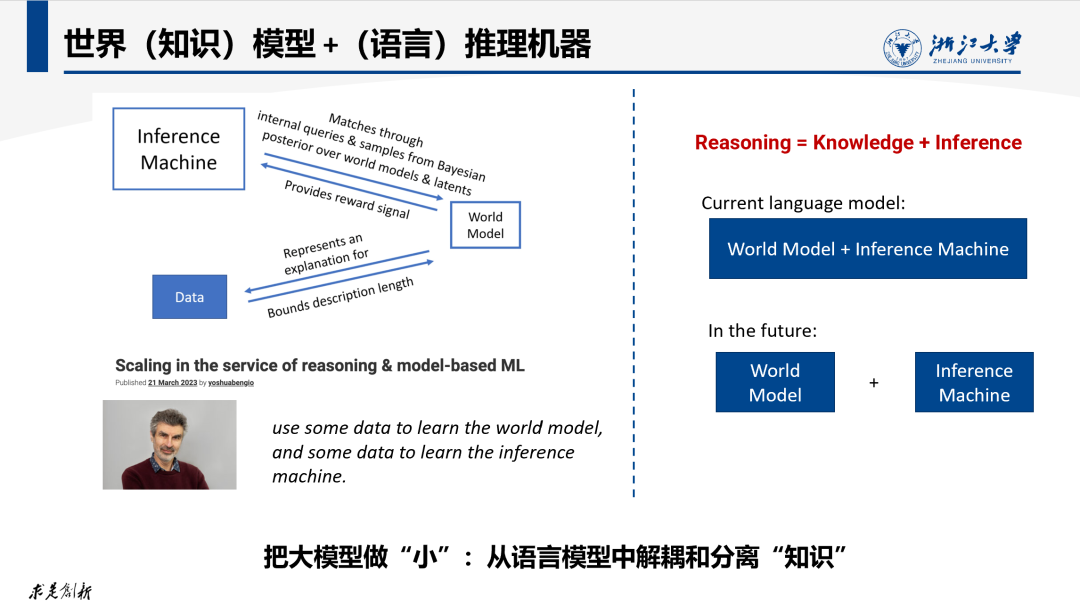

1.3 世界(知识)模型 vs (语言)推理机器

大模型“大”的本质原因是它需要大量的参数来表征海量的世界知识。正如Bengio在其最近一篇博文中所指出,当前大模型中的参数实际上包含两部分:世界模型(World Model)和推理机器(Inference Machine)。世界模型用于存储世界知识:事实上,大模型中的大部分神经网络参数都是用来存储知识的。而用来进行推理计算的推理机器是依靠语言模型来实现。

或许是因为人的知识推理也极大的依赖语言理解能力和过程,在大模型中“语言”和“知识”也是浑然一体密不可分的。这和传统符号AI的实现是很不一样的,在传统符号AI如专家系统架构中,知识库和推理引擎是两个独立实现的模块。但Bengio也同时指出,未来的大模型或许应该将世界模型和推理机器进行适当解耦,这样存储知识的部分可以独立进行验证和维护,这或许是控制模型规模和提高模型知识的可验证性和可靠性的一条可能路径。

总而言之,知识图谱和大型语言模型都是表示和处理知识的手段。“语言”和“知识”一定程度是密不可分的,而大模型则补足了语言理解的能力,为更有效的处理和利用知识扫除了语言理解的障碍。但文字序列结构并不能覆盖所有的知识表示形式,而知识图谱则刚好丰富了知识的表示形式和方式。两者的深度结合,可以为人工智能提供更加全面、更加准确、更加可控的知识处理方法。

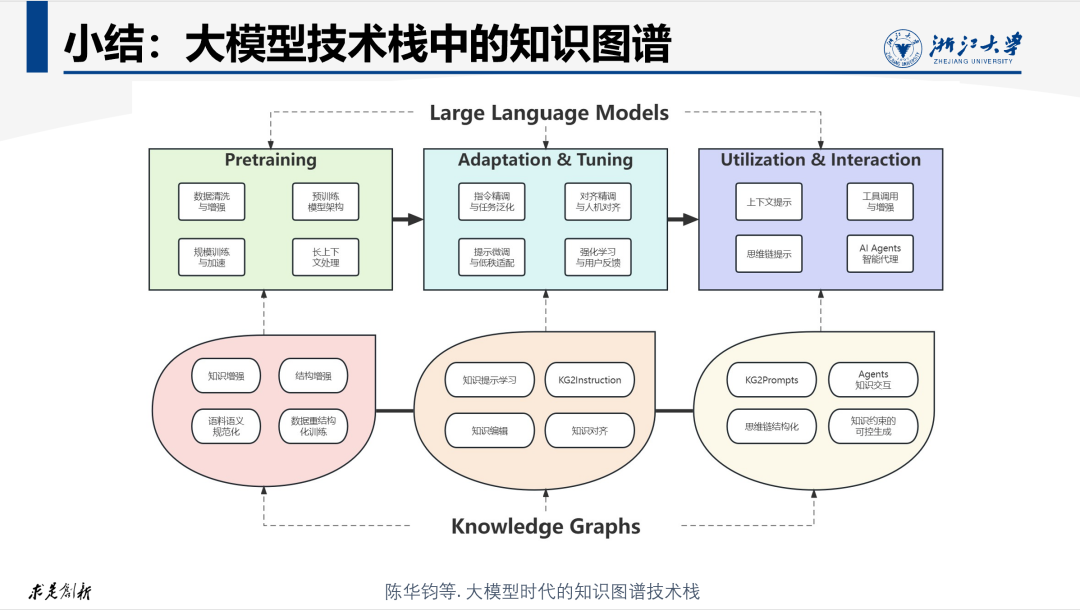

02 大模型技术栈中的知识图谱

接下来,我们谈谈知识图谱对于大模型的价值以及在大模型技术栈中的位置。大型语言模型核心技术要素包括:基础模型训练、指令精调、提示工程、思维链、奖励模型与人机对齐等。知识图谱相关的技术理念和要素在大模型技术栈的各个环节都可以发挥作用。

2.1 知识增强与结构增强

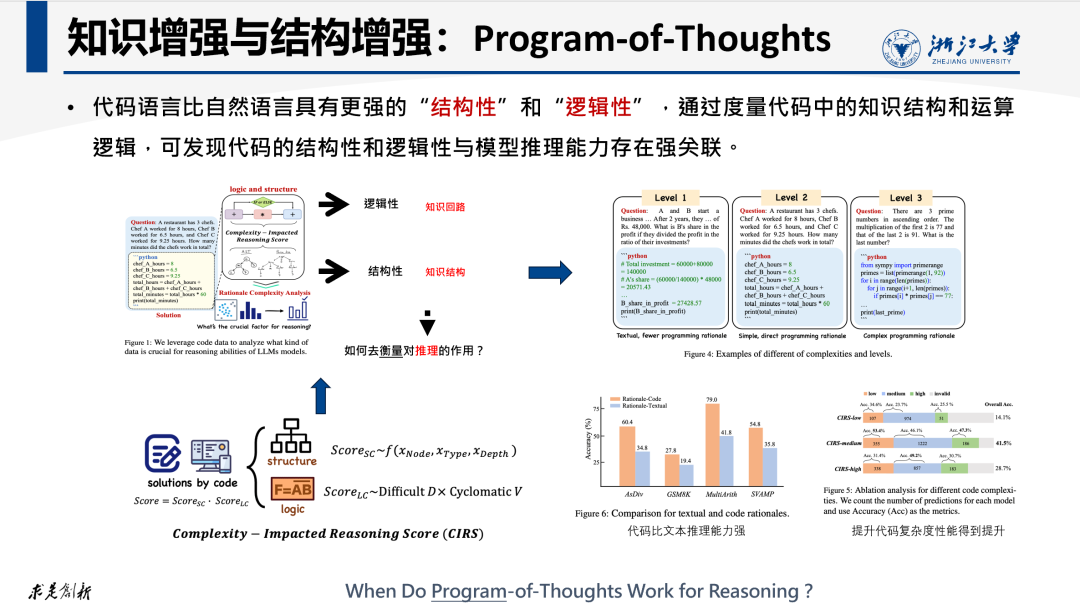

越来越多的研究表明,不论是在预训练阶段还是在指令提示阶段,提升语料的语义规范性或数据的结构化水平均有助于增强模型推理能力。例如,代码语言比之自然语言结构化更好,同时其中包含大量的运算逻辑,不仅可以实现代码生成能力,也更利于激活模型推理能力。思维链比之普通的自由文本包含更多的逻辑关联性描述,因而更有利于提升模型推理能力。进一步研究表明思维链在模型规模到一定程度(>100B)才能诱发思维链推理能力,这可以解释为更大规模的模型蕴含更多用于推理的隐式知识,而这些知识的激活则需要逻辑性更强的提示。

为进一步探索代码结构与推理能力之间的关联关系,我们开展了一项“Program of Thoughts”的研究工作。我们首先定义了一些衡量代码结构性和逻辑性的指标,以此来衡量不同形式代码中的结构性知识的丰富程度。例如,一个包含复杂循环逻辑的代码比简单的变量赋值包含更丰富的运算逻辑,因此其结构性和逻辑性得分更高。然后我们把这些结构性不同的代码作为prompt来驱动模型的问答,并对其推理结论的正确性比例进行分析。在多个测试数据集上的实验分析表明,结构性和逻辑性更强的代码提示更加有助于激活模型的推理能力。

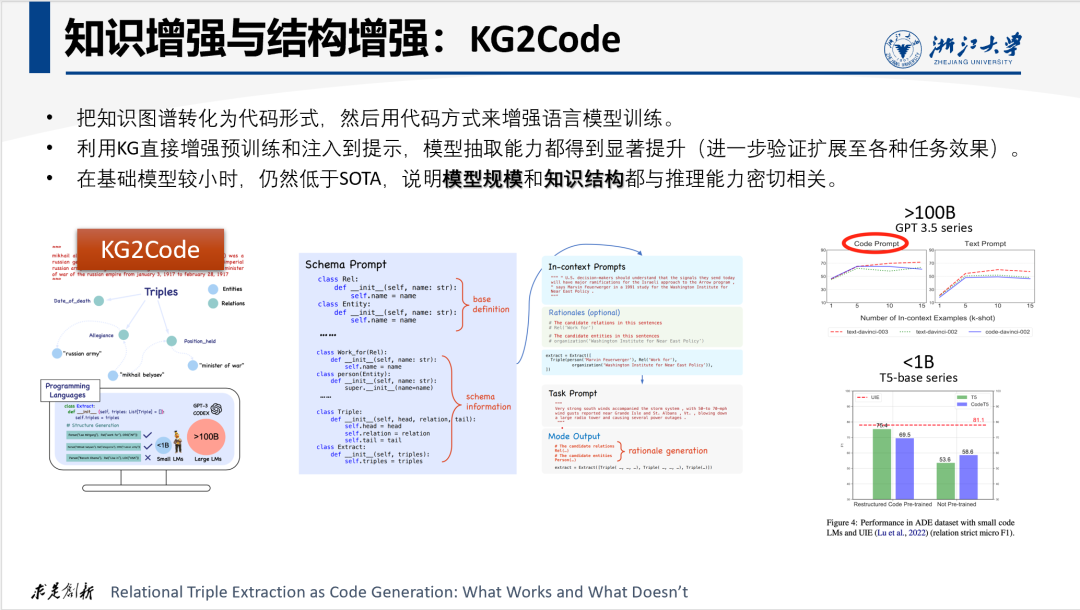

代码语言并不适合描述常识知识和完成常识推理,而知识图谱可用于描述常识知识。为进一步探讨知识结构对于常识推理的影响,我们尝试将KG中的结构化知识转化为对应的代码形式:例如KG中的类对应面向对象代码中的类,KG中的属性和关系转化为对应的成员变量。然后以这种代码形式的KG作为Prompt或者直接在Base模型预训练阶段进行注入,来测试其对下游任务的影响。实验结果表明,注入有知识图谱结构的模型在多个方面的能力得到提升,特别是在抽取任务方面得到显著提升。但在模型整体规模较小时,其能力仍然低于SOTA,说明模型规模和知识结构性都与推理能力都密切相关。

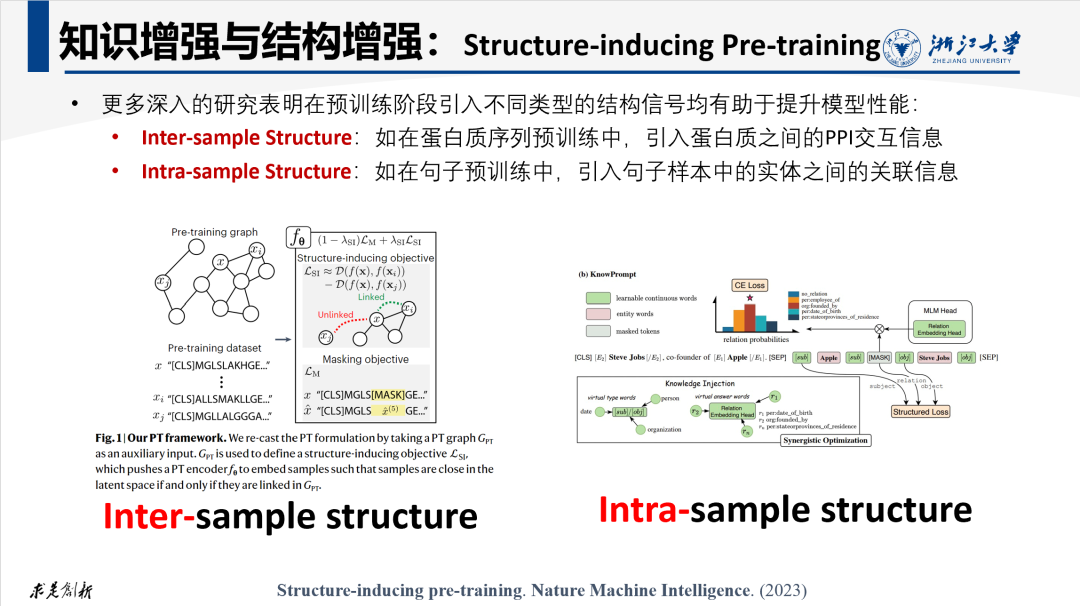

我们再从样本Sample的视角讨论一下结构增强。这项称为“Structure-inducing Pretraining”的研究探讨了建立训练样之间的结构化关联关系对于提升模型性能的作用。在该文中,作者综述了当前预训练模型对于样本结构信号的利用情况,并指出大部分模型在这方面考虑不足。并进一步从理论分析和实验验证系统性分析了在模型训练阶段注入结构信号的价值。这些结构信号包括:Inter-sample Structure(如在蛋白质序列预训练中,引入蛋白质之间的PPI交互信息)和Intra-sample Structure(如在句子预训练中,引入句子样本中的实体之间的关联信息)。

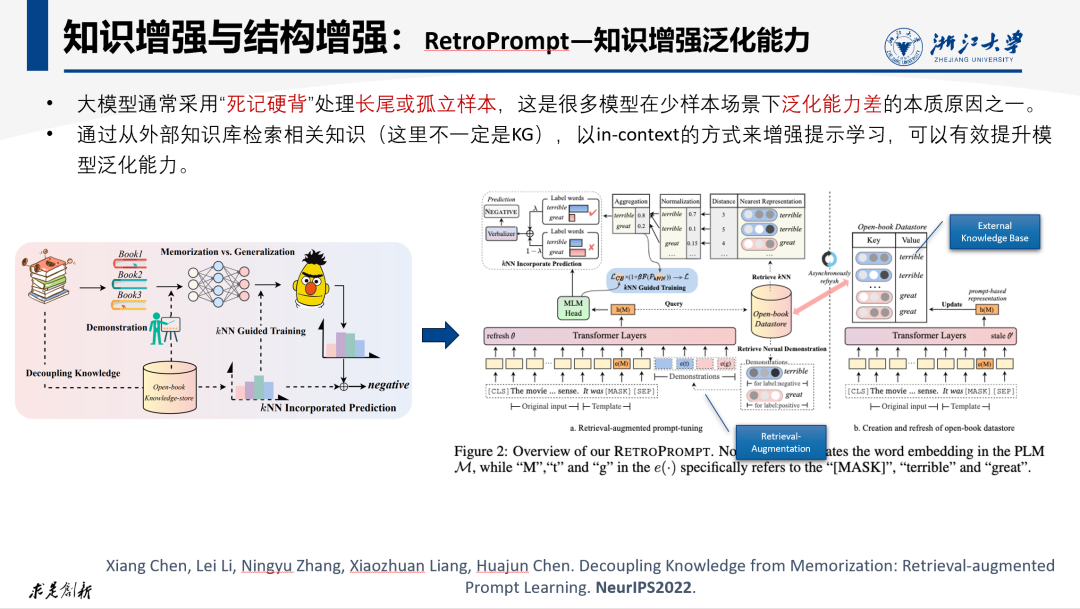

外部知识还可以增强大模型的泛化能力。我们在NeuralPS2022上发表的一个工作——RetroPrompt就是探讨这个问题。大模型通常采用“死记硬背”处理长尾或孤立样本,而不是真正学习到样本中的规律,这是很多模型在少样本场景下泛化能力差的本质原因之一。这就好比一个只知道死记硬背的学生举一反三的能力就比较弱。RetroPrompt通过将知识与记忆解耦,即单独训练一个知识库(这里不一定是KG),然后通过从这个知识库检索相关知识,以in-context的方式来增强提示学习,可以有效提升模型在少样本场景下的泛化能力。

做个小结,我们可以把训练语料中的知识按照结构化水平或语义规范化程度大致分个层级:文本序列知识(包括自然文本序列、带思维链的自然文本)、结构化知识(概念层次结构、实体关联结构、时序结构)、逻辑规则知识。语料中知识结构化水平越高,数据质量越高,将更有助于提升模型性能,但语义逻辑的规范化程度越高,意味着语料获取的难度越大,规模不容易扩大。因此,提升语料的知识结构化水平可以增强模型能力,但与提升模型规模之间存在平衡关系。

2.2 提示工程即知识工程

提示(Prompts)是指在训练或使用大模型时使用的一类引导性指令,如问题描述、上下文信息、举例示例、结构模板、思维链等。通过提供明确的提示或指令,模型可以更好的理解人的意图和要求,产生更加遵循人类指令要求的输出。事实上,大模型所体现出的“智能”很大程度上是由提示工程阶段所植入的知识所驱动的。

大量实践表明,提示设计的好坏和详细程度对模型输出结果影响巨大。在预训练阶段所使用的诸如“Next Token Prediction”的监督信号仅能编码基础的、通用的、浅层的语义和知识。而“提示”则包含有大量任务特定的知识,这些知识不只是描述人的意图和问题指令,还可能包括人的思维逻辑(如思维链)、类比逻辑(如举例示例)、与任务相关的实体及关联关系等事实性上下文信息等。特别是在模型微调训练阶段,大量以提示或指令形式存在的先验知识被编码进大模型,大幅提升语言模型的回答复杂问题和逻辑推理的能力。

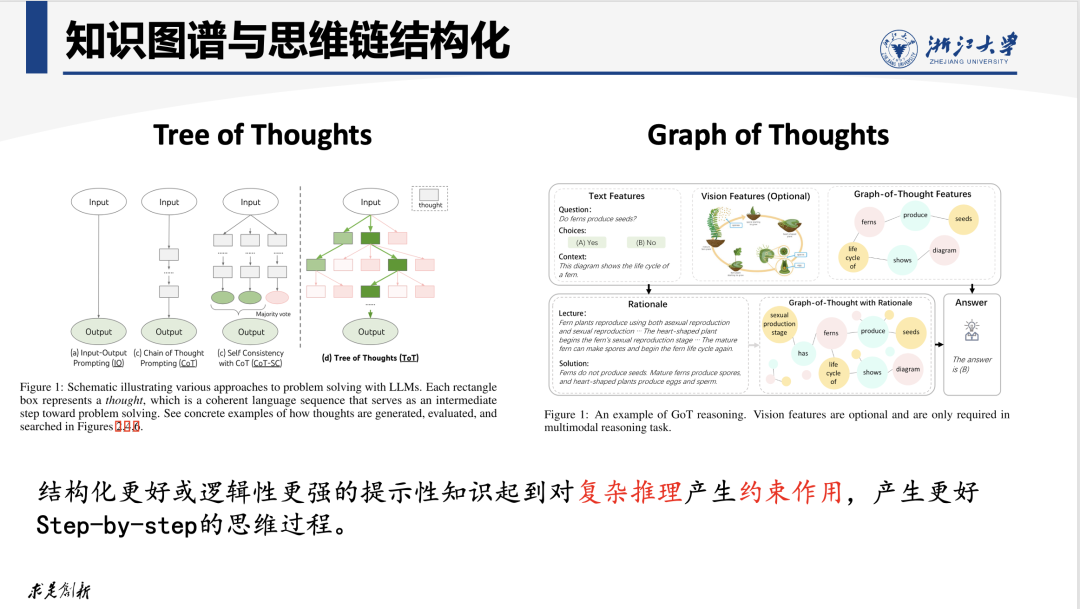

提示工程本质就是知识工程。越来越多的研究表明提示知识的结构化和逻辑性,与模型推理能力密切相关。从最简单的文本提示(Textual Prompt)和带思维链的文本提示(CoT),到代码提示(Program of Thoughts)、树型提示(Tree of Thoughts)、图提示(KG of Thoughts)等结构化更强的提示,甚至直接以逻辑规则作为提示,随着提示知识表示水平的提升,模型推理能力可以得到提升。但推理能力的另外一个重要因素——规模涌现,又与提示知识表示水平相矛盾:表示水平越高,提示知识获取难度越高,模型的规模涌现越不容易实现。因此,在大模型时代,知识表示水平与推理能力的正比关系仍然存在,而表示复杂度与模型规模化的矛盾关系也依然存在。构建和获取高质量的提示语料(即提示工程)本质上就是获取人类先验知识过程,这和传统知识工程的目的本质上是相似的。高质量的提示工程和传统知识工程一样,也是耗时费力的。

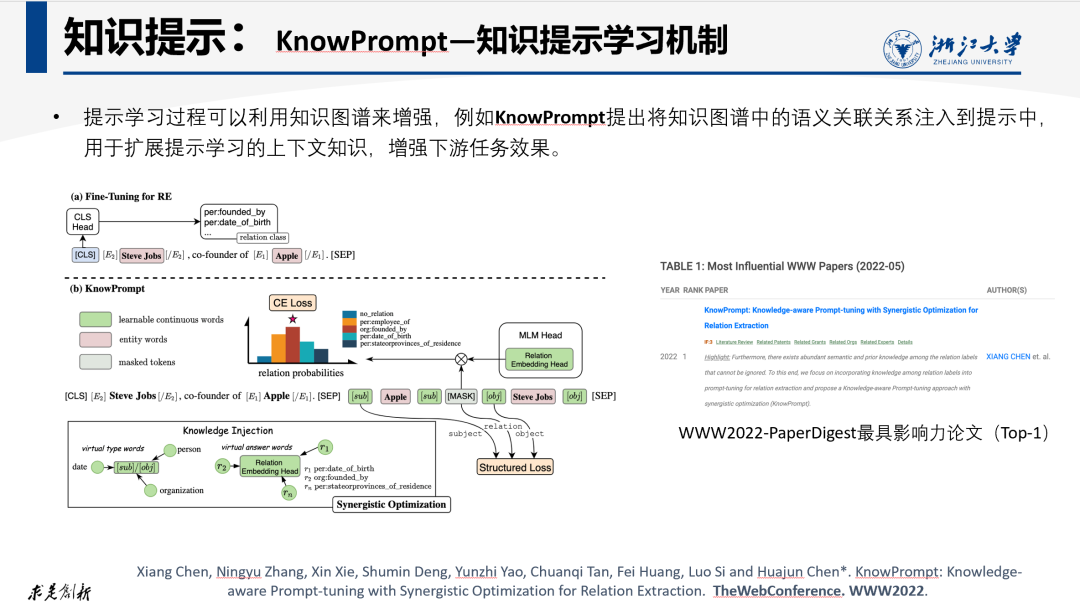

知识图谱中的知识是可以用来增强提示学习过程的。例如,我们在WWW2022发表的一个工作KnowPrompt就提出将知识图谱中的语义关联关系注入到提示中,用于扩展提示学习的上下文知识,实验表明,注入知识后的提示能更好激活模型能力,增强下游任务效果。该工作也是WWW2022-PaperDigest的最具影响力论文。

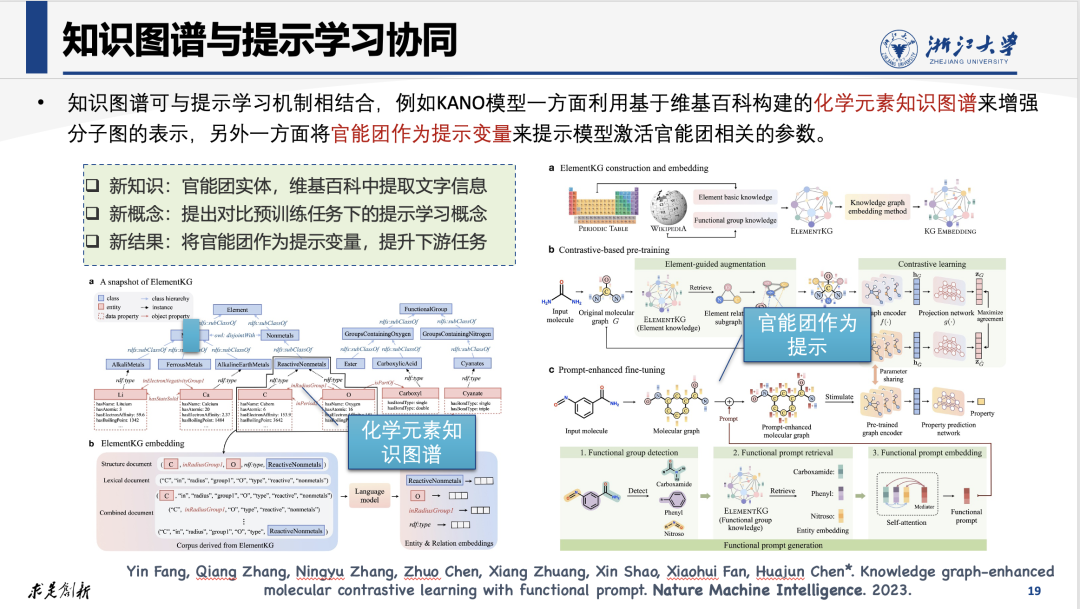

知识图谱可与提示学习机制相结合。下面这篇工作是我们团队今年发表在Nature机器智能子刊上的文章:“Knowledge graph-enhanced molecular contrastive learning with functional prompt.”。文中介绍的KANO模型一方面利用基于维基百科构建的化学元素知识图谱来增强分子图的表示,另外一方面将官能团作为提示变量来提示模型激活官能团相关的参数。

2.3 知识图谱与思维链结构化

关于提示学习中的思维链CoT(Chain of Thoughts)还可以单独再深入探讨一下。思维链是一类特殊的提示,它模拟了人们在思考和解决问题时,通过联想将不同的概念或知识关联起来的过程,从而引导大模型模仿人的逻辑思维过程。显然知识图谱是表示和生成思维链的好帮手。前面已经谈到,采用结构化更好的思维链表示形式(如Tree of Thoughts,Graph of Thoughts等)比之自然语言形式的思维链更有利于诱导出大模型的推理能力。

一方面,人们可以按自己的兴趣和要求,将不同的概念和思维步骤关联起来,形成逻辑更加清晰的思维链知识图谱(KGoT),这种结构化的思维链可以直接作为提示的一部分输入到模型中,也可以利用KG2Text自动化生产所需的自然语言形式的思维链,再注入到模型中。另外一方面,知识图谱中的概念和实体提供了丰富的知识关联,通过实体链接技术与手工编写的思维链进行关联,可以便利的扩展和增强自然语言形式的思维链,使得思维链更加接近于人的联想思维模式。

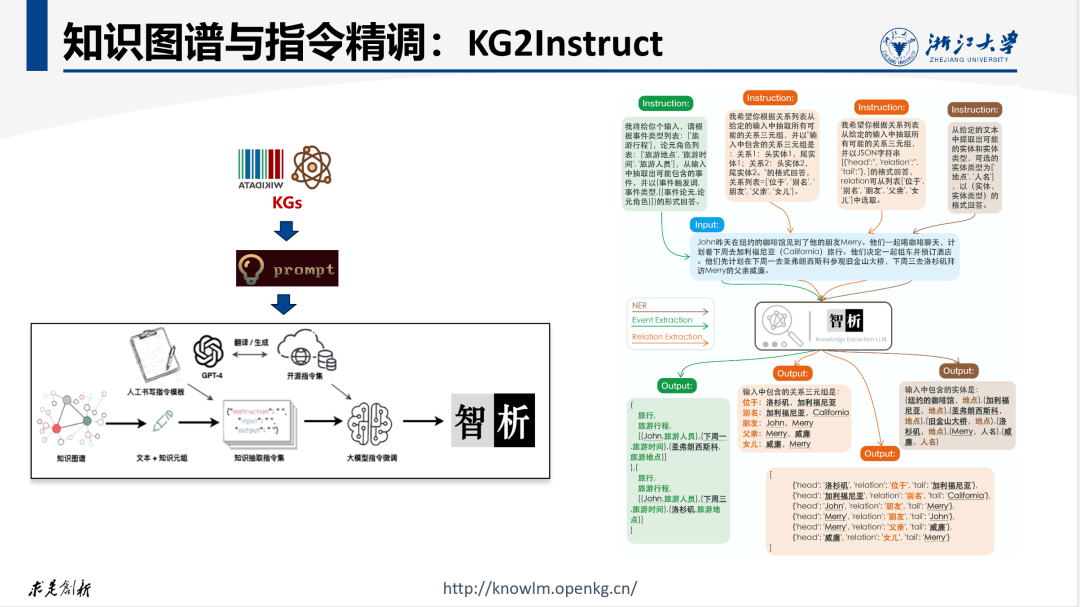

2.4 知识图谱与指令精调

指令精调是指在预训练模型的基础之上,通过将任务特定的监督数据转化为指令或提示形式,进一步训练和微调以提升模型的性能和准确性。由于各种不同任务的数据都以统一的指令形式输入到模型进行训练,这使得模型具有更好的任务泛化能力,即解决新问题或完成新任务的能力。知识图谱中的知识可用来增强指令提示或直接用于生成指令数据集。例如,知识图谱中的实体属性和关联信息可以用于丰富指令的上下文信息。通过查询知识图谱,可以获取实体之间的关联和属性,并作为提示工程的一部分。

下图展示了一个利用知识图谱直接构建知识抽取指令的例子。该模型基于KG2Instructions技术产生的大量指令数据来提高语言模型对于人类抽取指令的理解。具体基于维基百科和WikiData知识图谱,通过远程监督、Schema约束过滤等方法构建大量的指令数据,并通过随机采样人工指令模板的方式提升指令的泛化性。

比之自由文本,知识图谱是逻辑结构关联更加丰富,知识密度更高的数据语料。很多领域的知识图谱数据来源于长久人工积累(如Gene Ontology)或天然的结构化数据转化而来。充分挖掘和利用好知识图谱中所包含知识结构(如层次概念、实体关系、事理时序、规则逻辑等)来增强和丰富提示指令或辅助构建逻辑性更强的指令数据集,可以帮助模型完成更加复杂的任务。

2.5 大模型的知识编辑与知识对齐

大模型的一个众所周知的问题是幻觉与知识谬误问题。由于模型给出的答案是从神经网络中通过参数的组合生成出来,而非从确定的文本内容检索出来,一旦模型出错,既不容易定位错误的来源,也不易于对参数化的知识进行更新。更为困难是知识参数化之后,彼此高度关联,改动一条知识更容易出现“牵一发动全身”的后果。

幻觉、出错以及不确切的回答是大模型智能得以涌现所需要付出的代价,同时也是大模型得以实际应用必须要客服的技术挑战。模型编辑技术实现在神经网络空间对参数化的知识进行增删改,以纠正错误的知识,删除有害的知识和约束错误的生成。但在极大规模的参数空间对知识进行编辑并不是件简单的工作,这首先需要在神经网络中定位错误的知识,确定修改的边界,更新参数的机制和方式等。由于神经网络的参数之间是高度关联的,改动其中任何一个神经元都会对与之相关的其他神经元产生“牵一发动全身”的影响。更改其中一条知识需要充分考虑知识之间的逻辑依赖关系。可以利用符号化知识图谱中显式定义的事实之间的关系,来辅助确定参数化知识之间的关联关系并确定参数更新的边界。

更一般而言,由于知识图谱中的知识很多都经过人工审核和校验,相对标准和正确,因而可以为矫正模型的对齐目标。例如可以利用知识图谱为奖励模型提供反馈信号,通过将大模型返回的结果与知识图谱中的事实、关联或约束进行比较,以提供反馈信号来改进生成的结果或衡量模型的性能。因此,定义良好的知识图谱可以作为矫正大模型的对齐目标。

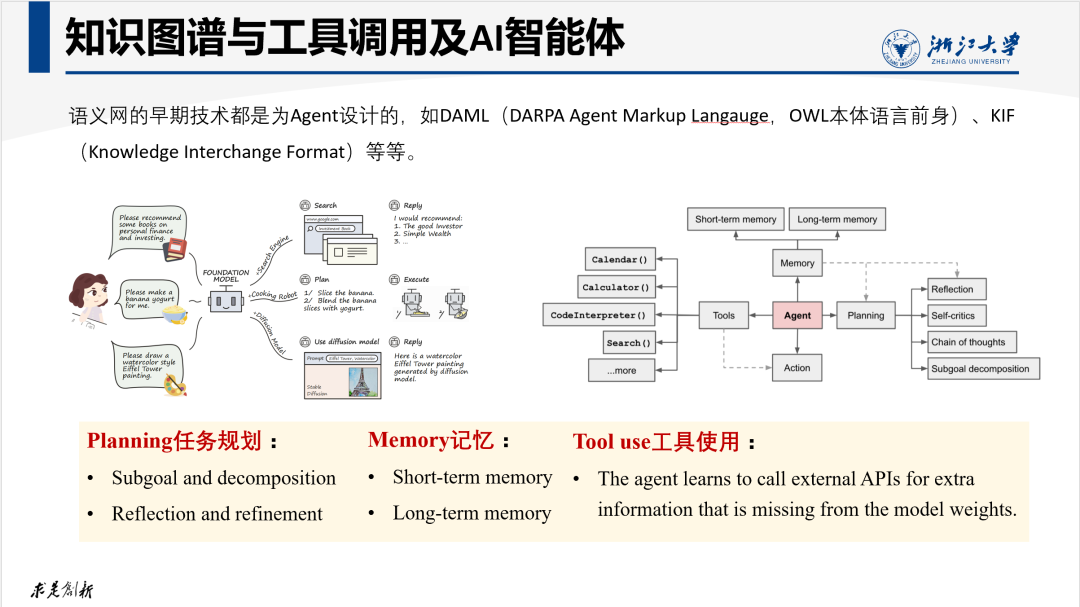

2.6 知识图谱与工具调用及AI智能体

工具增强的语言模型(Tool-Augmented Language Model)在模型自身无法解决问题时可以调用外部工具来完成。这些工具可以是数学计算器、数据库访问接口、特定功能API等。一个复杂的任务可能需要组合调用多个工具,形成复杂的工具调用逻辑结构。大模型要自主的学习这种复杂的工具调用逻辑仍然是有困难的,而知识图谱可用于复杂API组合调用逻辑的建模中,这在传统服务计算架构领域已经有很多这方面的实践。

更一般化的工具调用是AI智能体之间的智能交互,即:Agent之间互为工具,在某个Agent自己无法完成特定任务时,将会向外寻求其他多智能体的协作和帮助。知识图谱和多智能体有着深刻的历史渊源。早期知识图谱技术如RDF/OWL等设计的本意是为了便于互联网多智能体Agent进行知识获取,并作为Agents之间的知识交换格式(Knowledge Interchange Format)。例如OWL语言的前身之一DAML正是Agent Markup Langauge的缩写。语言模型技术的成熟为多智能体之间进行知识交换和知识交互提供了新的方式。工具增强的大模型可以帮助Agent自主的学习其他Agent的调用和交互方式,在自己的知识无法解决当前问题时,自主的去寻找其他Agents的协助,并且无需基于由人工定义的知识交换接口。这使得Agent之间能更加自主的实现知识协同,建立更加强大的智能体协作社区。

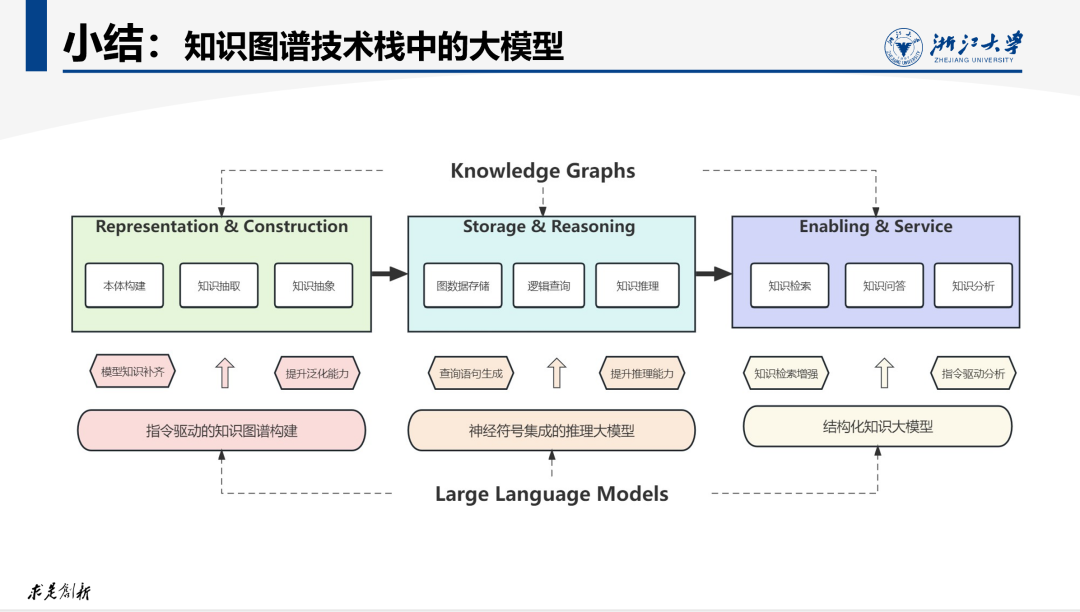

作为小结,知识图谱在基础模型预训练、模型适配与微调、模型使用与交互等环节均能发挥作用,这包括:通过提升训练语料、提示指令的结构化和逻辑性来进一步提升模型能力,降低训练代价;将知识工程的理念及经验融入到提示工程及提示库的建设;利用知识图谱来矫正知识谬误和控制幻觉生成等等。可以预见在未来飞速发展的大模型技术栈中,将看到越来越多的知识图谱相关技术理念。

03 知识图谱技术栈中的大模型

接下来我们反过来看看大模型对于知识图谱的价值。知识图谱的核心技术要素包括表示、存储、抽取、推理、融合、推理、问答、分析等。同样的,大模型技术在知识图谱的各个环节均能发挥作用。

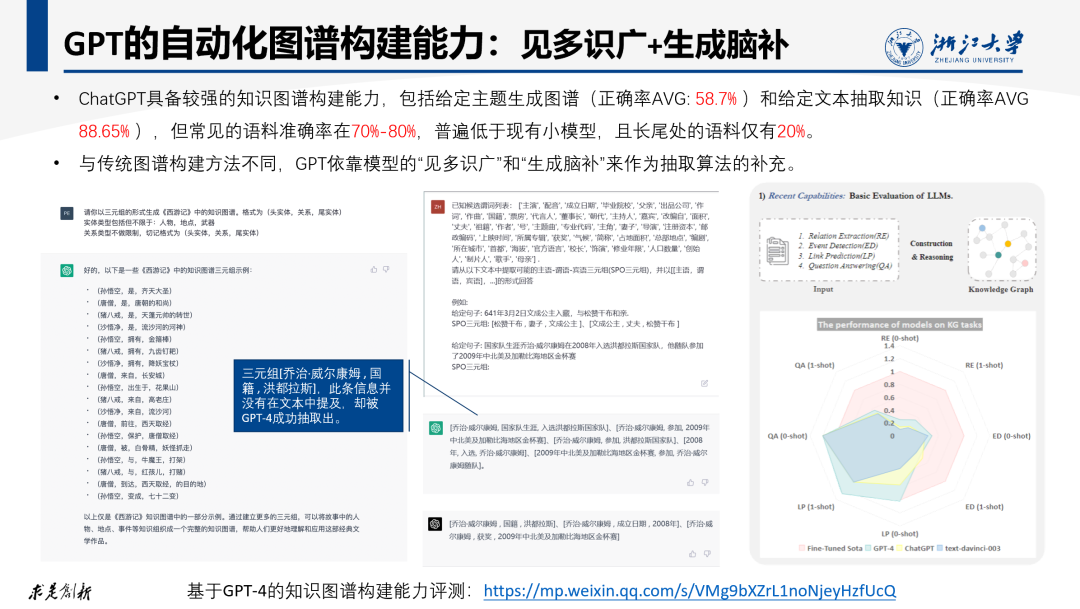

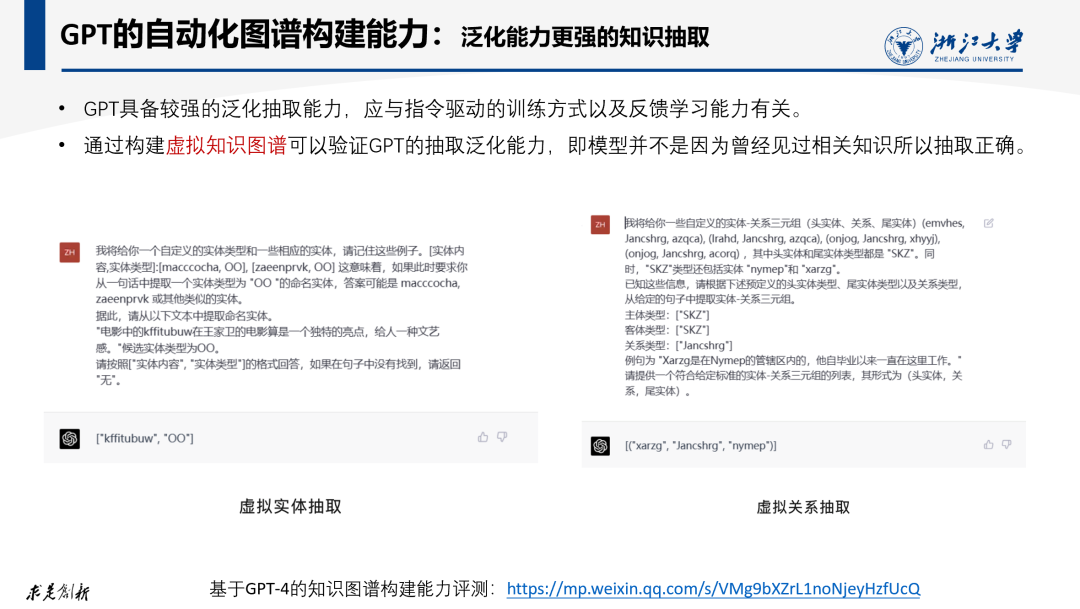

3.1 ChatGPT的自动化图谱构建能力

大家所普遍关心的首先是大模型的自动化知识图谱构建能力。对此,我们对GPT4的图谱构建和抽取能力进行了深入评测,详细评测报告可参见PPT中给出的评测报告链接。经过评测,ChatGPT的确具备较强的知识图谱构建能力,包括给定主题(如:浙江大学)生成对应的知识图谱,但由于GPT极大依赖生成模型来生成知识图谱,其幻觉问题导致生成的知识图谱的正确率在我们给定的测试集中平均只有 58%。 如果给定文本要求GPT按要求抽取知识,其正确率平均可以达到88% ,但仍然低于现有小模型的SOTA。更为广泛的评测发现ChatGPT对于常见的语料准确率在给定测试集中大部分在70%-80%,且长尾处的语料仅有20%。

需要特别指出的是,与传统图谱构建方法不同,GPT依靠模型的“见多识广”和“生成脑补”来作为抽取算法的补充。即它会从模型参数中提取知识或直接生成一些知识来补充抽取结果,尽管结果中的一些知识并没有出现在待抽取的文本中。

为了验证GPT并非完全是因为曾经见过相关知识(即训练语料中有相关知识)所以抽取正确,我们设计了一个虚假知识图谱,即让机器随机生成一些毫无意义的虚假实体和虚假关系,确保模型不可能在训练语料中见过这些实体或关系类型,再生成一些包含这些虚假实体和关系的文本,然后通过指令要求GPT从这些文本中抽取出对应的实体和关系。

实验结果表明GPT仍然能够较为准确的实现抽取。这说明GPT具备较强的泛化抽取能力,这应该与指令驱动的训练方式以及GPT的反馈学习训练过程有关。因此发展指令驱动的知识图谱构建和知识抽取技术是有重要价值和意义的。

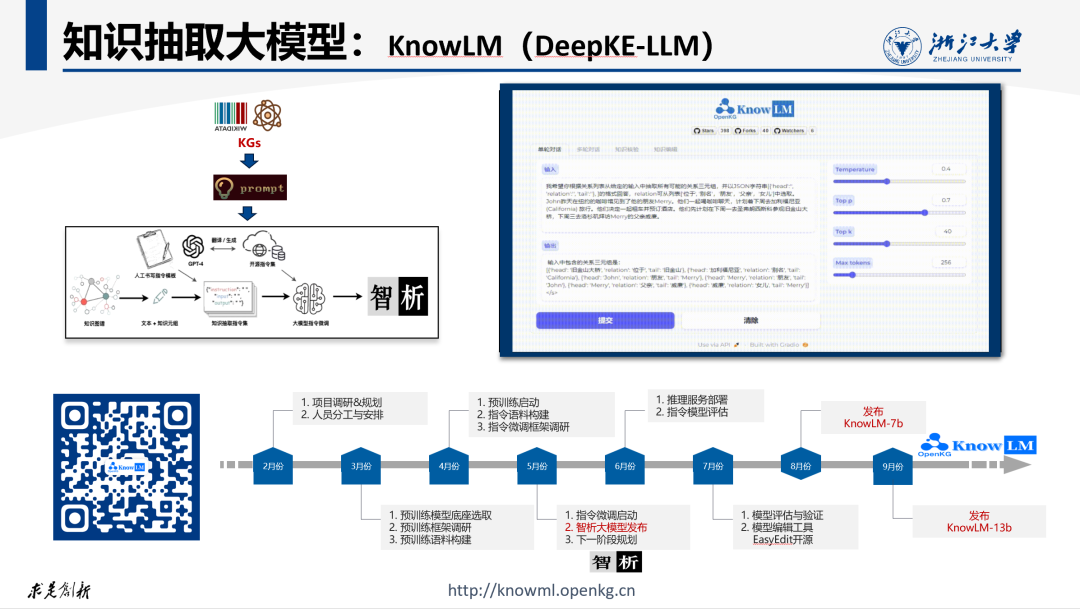

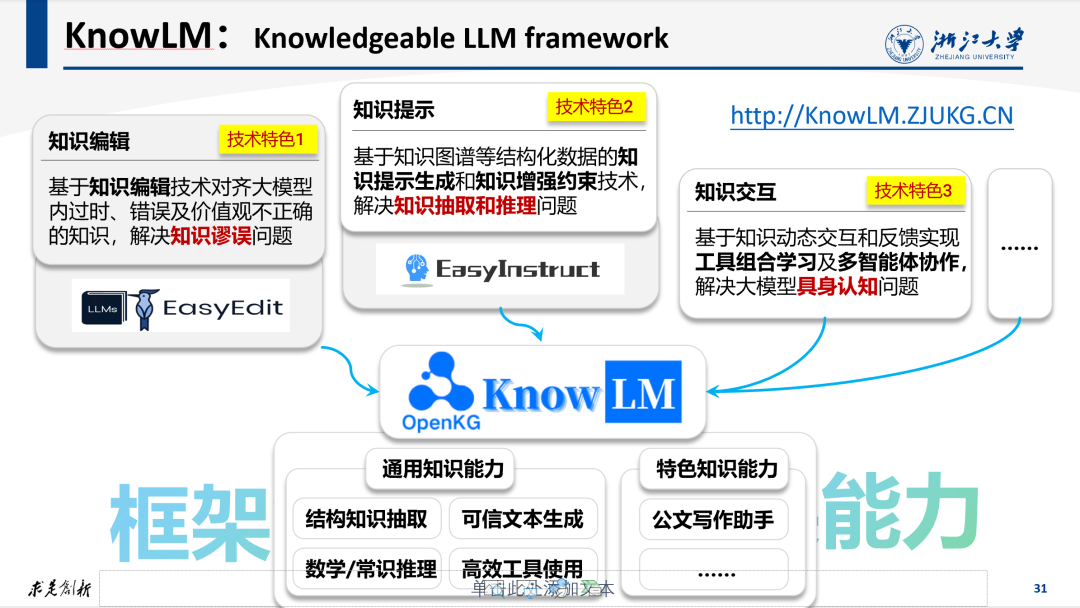

3.2 知识抽取大模型

前面已经提到,我们可以基于指令驱动的方法来构建专门面向知识抽取的大模型,研究表明这类抽取大模型在知识图谱构建方面具有独特的能力:

● 模型脑补:大模型本身就学习有海量的参数化知识,这使得可以同时从文本语料和参数空间抽取知识,通过模型的“见多识广”来对文本抽取的结果直接进行模型脑补,可以大幅提升知识图谱构建的效率。

● 更强泛化:大模型通过指令学习和人类反馈具备了较强的泛化能力,同样的通过指令驱动的抽取大模型也具备更强的抽取新类型、新关系、新事件的泛化能力。研究表明,即使对于从未见过的实体或关系类型,大模型同样具有高精度的识别效果。

● 生成补齐:大模型具有较强的生成能力,在模型或文本中均缺乏所需的知识时,大模型可利用其生成能力来通过知识生成来补齐知识图谱。生成式的知识图谱本质上利用了大模型的推理能力,但可能会生成错误知识。

DeepKE-LLM(KnowLM)是我们基于指令驱动的思想训练的抽取大模型。我们首先基于WikiData等知识图谱数据,并结合人工模板构建知识抽取指令数据集,再利用该指令数据集对基座模型(主要支持Llama系列模型)进行微调,来提高模型对抽取指令的理解。实验表明,经过抽取指令精调的DeepKE-LLM在多个抽取任务上均好于ChatGPT。

抽取实际上是一个比较基础的任务。从某个程度而言,抽取即理解,也就是说如果能对文本中的知识进行高质量的抽取,就代表模型能够一定程度上理解文本的语义。所以,我们也期望基于抽取指令精调过的模型在其他任务上性能也能有所提升。因此,我们将DeepKE-LLM扩展为具备其他知识处理能力的模型,并特别在知识编辑、知识提示与指令、知识交互与AI智能体方面进行能力增强。感兴趣的朋友可以持续关注KnowLM的后续工作。

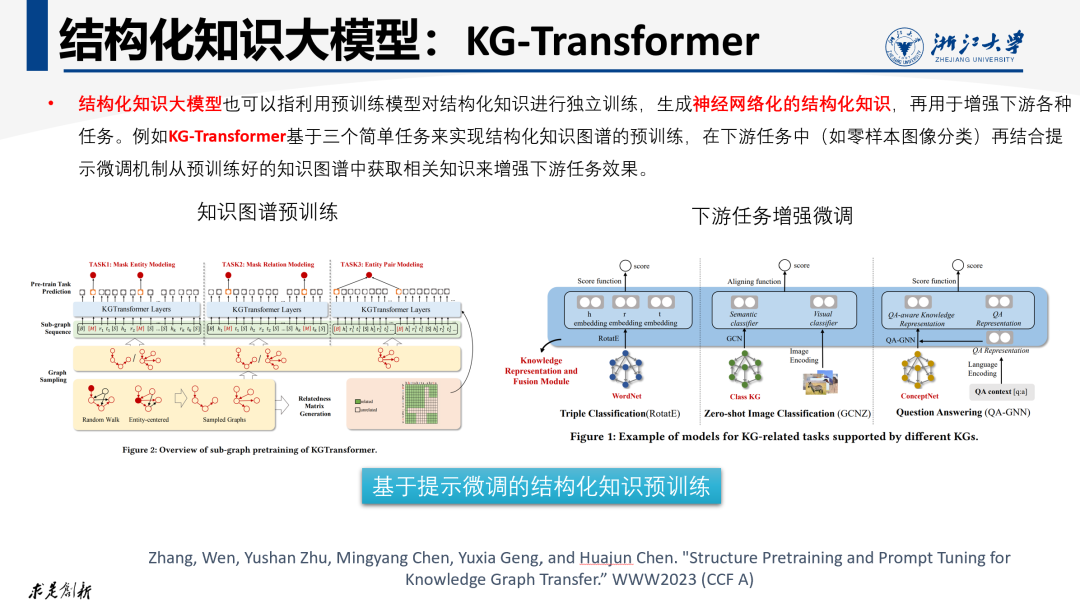

3.3 结构化知识大模型

结构化知识大模型是指针对结构化知识(如知识图谱、表结构等)进行操作的预训练语言模型,例如可以利用LLM对知识图谱进行逻辑查询、问答及增删改等操作。大模型的语言理解能力使得我们可以较为精确的实现自然语言到结构化查询语言(如SPARQL、Cypher、Gremlin等)自动化翻译。这就极大的便利图数据的管理与维护,以及基于图数据库的应用开发。例如,大模型框架LangChain已经增加了Cypher插件,可以方便的从自然语言生成Cypher图查询语言。此外,大模型也可以通过检索增强的方式,融合结构化知识和语言模型共同增强查询问答结果。当然,我们也可以通过定制提示模板,直接把结构化知识库提交给大模型,以in context learning方式利用LLM对结构化知识进行查询和问答操作。

结构化知识大模型也可以指利用预训练模型对结构化知识进行独立训练,生成神经网络化的结构化知识,再用于增强下游各种任务。例如KG-Transformer基于三个简单任务来实现结构化知识图谱的预训练,在下游任务中(如零样本图像分类)再结合提示微调机制从预训练好的知识图谱中获取相关知识来增强下游任务效果。

一些研究表明,现有大模型在处理天然依赖结构化数据的任务方面,除查询问答类因为依赖自然语言生成结构化查询表现较好以外,其他例如链接预测、关联挖掘、子图分析、时序预测等任务仍然无法超过传统小模型。但大模型的知识预先训练、指令驱动的泛化能力、奖励模型与对齐学习等思想均可用来增强结构化知识的处理能力。我们可以通过设计更加适合编码结构化知识的基础模型训练机制、通过将结构化数据指令化实现指令驱动的结构化任务处理、面向结构化数据任务的奖励模型等,提高大模型分析和处理结构化知识的能力,这对于很多依赖结构化数据的大数据分析类应用领域具有重要价值。

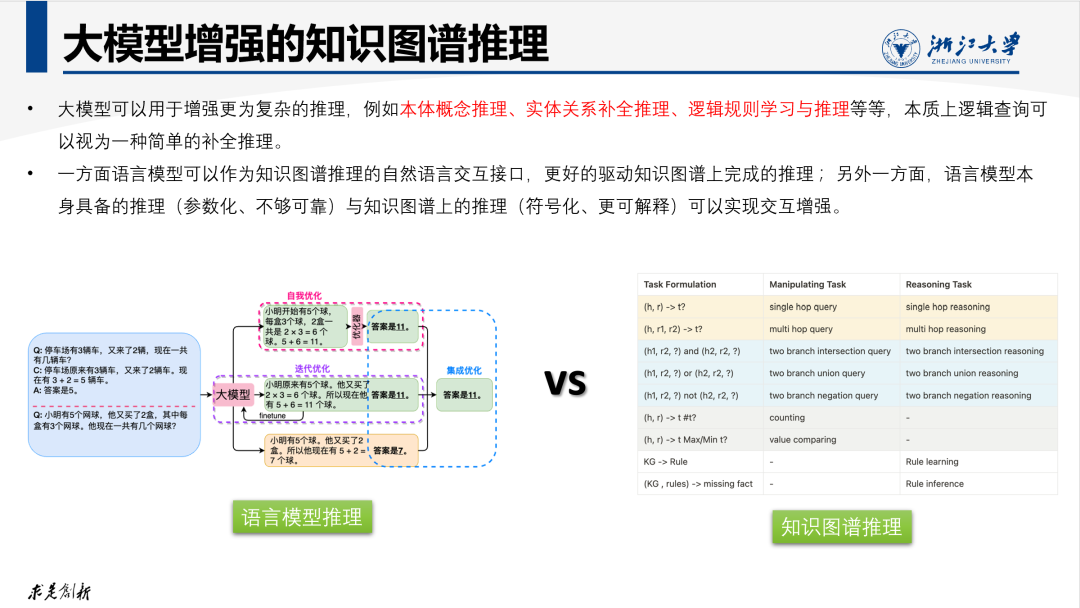

3.4 大模型增强的知识图谱推理

常见的知识图谱推理方法一般可以分为基于符号表示的推理和基于嵌入或图表示学习的神经网络推理两种方法。符号方法基于显示知识,推理过程明确可解释,答案确定,但泛化能力差;神经网络方法基于隐式知识,推理泛化能力更好,但不能给出确定答案。因此,研究人员发展出将两类方法相结合的神经符号集成的推理方法。

大型语言模型把自然语言形式的符号知识参数化,也是一种在神经网络空间实现的推理。但与传统图神经网络、知识图谱嵌入等推理方法不同,大模型还依靠“见多识广”的知识丰富性和“模型脑补”的生成能力来增强推理的完备性和更强的泛化能力。因此,大型语言模型可以和传统符号知识图谱推理方法形成更好的互补。例如,一方面,大模型可以将符号知识图谱作为外部可调用的工具,在需要确定答案时,利用符号知识图谱的推理来给出更加可靠、明确和确定的答案。另一方面,在符号知识图谱推理因为知识缺乏而推不出答案时,可以利用大模型的见多识广和高泛化能力来给出粗粒度的推理。

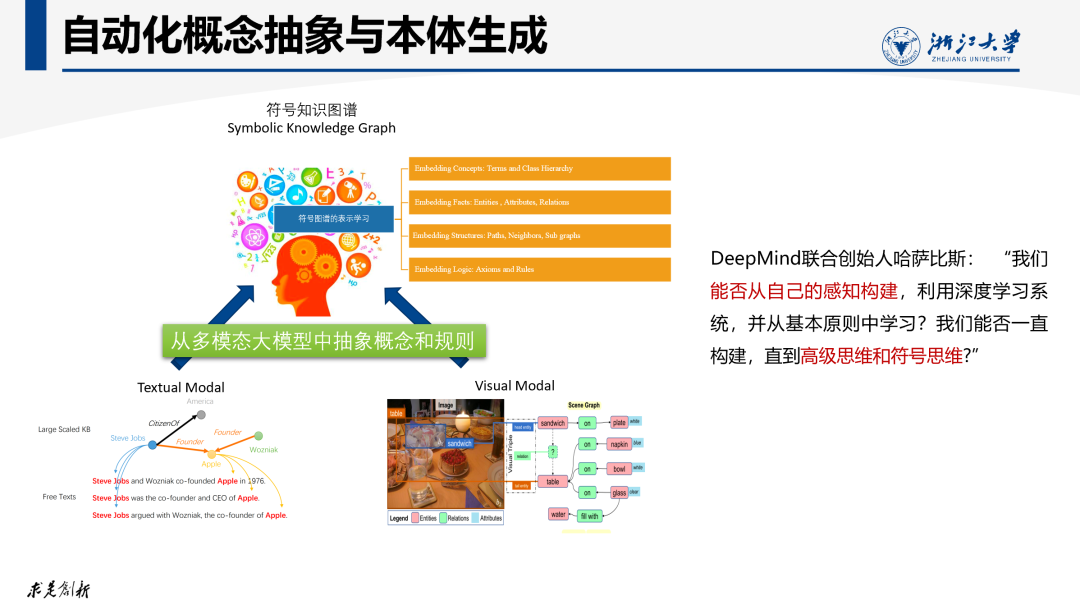

3.5 自动化本体与概念抽象

知识图谱的本质是建模关于世界的概念抽象,也就是本体Ontology。人大脑中的Ontology是在人认识世界万物过程中,通过归纳和抽象形成的关于世界万物的概念、类别、属性、关系以及它们的层次体系。大型语言模型从海量的文字语料中学习到丰富的有关字词及概念的知识,因而对概念的识别、理解、抽象能力表现突出。这为自动化的概念层次构建、类目扩展、属性补齐、本体对齐、概念归一化及更新处理提供了更强有力的技术手段。

DeepMind联合创始人哈萨比斯曾经提到: “我们能否从自己的感知构建,利用深度学习系统,并从基本原则中学习?我们能否一直构建,直到高级思维和符号思维?”。当前的大型语言模型仍然是从人类所产生的文本语料库中萃取和学习关于世界的知识。未来的大模型是否可以更多直接从与客观世界的感知交互过程中,依靠模型本身来总结关于世界的知识,抽象出关于世界的概念和本体,并直接用于决策或问答。

小结一下,在传统的知识图谱技术栈中,大模型也能在多个环节发挥作用,例如在知识图谱的构建阶段,指令驱动的知识图谱构建可以实现泛化能力更强的知识抽取,而大模型的见多识广有望帮助我们实现更加自动化的本体与概念抽象。通过构建结构化知识大模型可以利用大模型的语言理解能力大幅提升对结构化知识的查询、问答与更新等操作,而大模型的常识语言推理能力也可以与知识图谱的符号推理能力形成互补,相互增强。

04 总结与展望

最后我们从三个视角做一个总结:

● “语言” vs “知识”:语言和知识密不可分,语言模型与知识图谱都是用来处理世界知识的手段。以ChatGPT为代表的大型语言模型技术的发展代表人工智能表示和处理知识能力的大幅提升。

● “新KG”技术栈:在大模型时代,知识图谱不是没有用了,而是更加重要了,可以预见随着语言模型与知识图谱的深层次融合,一个全新的知识图谱技术栈会逐步演进和形成。

● 从“LLM”到“LKM”:人类知识高度复杂,很多知识是无法用自然语言序列来表示和描述的。我们在刻画客观世界时,更多采用的是多样化的结构化描述。大型语言模型只是起点,我们最终需要发展的是能够大规模编码和处理各种知识表示结构的大型知识模型(Large Knowledge Model)。

知识的表示与处理是人工智能自诞生以来的核心目标之一,而作为同样用来处理知识的大型语言模型和知识图谱各有优缺点。大模型补足了理解语言的能力,知识图谱则丰富了表示知识的方式,两者的深度结合必将为人工智能提供更为全面、可靠、可控的知识处理方法。

以上就是本次分享的内容,谢谢。

作者简介

陈华钧,浙江大学计算机科学与技术学院教授/博导,OpenKG牵头发起人。浙江省有突出贡献中青年专家,浙江省数智科技研究会副会长,中国人工智能学会知识工程专业委员会副主任,中国中文信息学会语言与知识计算专业委员会副主任。主要研究方向为知识图谱、大数据系统、自然语言处理等,以一作或通讯作在Nature Machine Intelligence、Nature Communications、NeurIPS、ICML、ICLR、IJCAI、AAAI、ACL、KDD、VLDB、ICDE、WWW、SIGIR、Nucleic Acids Res. 、Proceeding of IEEE等国际顶会顶刊上发表多篇论文。曾获国际语义网会议ISWC最佳论文奖、国际知识图谱联合会议IJCKG最佳论文奖、浙江省科技进步二等奖、教育部技术发明一等奖、中国中文信息学会钱伟长科技奖一等奖、阿里巴巴优秀学术合作奖、华为优秀学术合作奖、中国工信传媒出版集团优秀出版物一等奖、浙江大学首届优秀教材奖一等奖。

声明:本文来自开放知识图谱,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。