10月8日,科技部、教育部、工业和信息化部等10部门联合印发《科技伦理审查办法(试行)》(以下简称《审查办法》),将于2023年12月1日起施行。《审查办法》将涉及人工智能、算法和模型设计、个人数据处理等在内的科技活动纳入监管范畴,规范科学研究、技术开发等活动的科技伦理审查工作,强化科技伦理风险防控,促进负责任创新。

一、科技伦理审查制度的演变和发展

科技伦理审查,是指对科技研发、应用、推广等全过程进行的伦理性评价和监督,其主要目标是确保科技活动符合道德和伦理原则,保护人的权益,避免或减轻可能的负面影响。随着科技创新进程的不断加速,如何确保人工智能、金融科技、生命科学等科学技术向善、可持续发展,已成为各国在科技治理方面的一项重点工作。近年来,我国在科技伦理领域积极探索,《审查办法》所确立的科技伦理审查体系具有较强的政策延展性。

第一阶段:以生物医学领域为代表的伦理审查制度初探

我国于2016年便最先出台了《涉及人的生物医学研究伦理审查办法》,后随着人工智能等新兴技术的不断发展,我国伦理审查的关注视野逐步从聚焦于生命科学和医学研究领域,转向更为广泛的科技研究领域。2019年10月,我国成立国家科技伦理委员会,并设置人工智能、生命科学、医学等分委员会,将人工智能正式纳入国家科技伦理工作体系。

第二阶段:在顶层设计上明确科技伦理工作的重要地位

2022年1月,修订后的《科学技术进步法》正式施行,以立法形式明确提出国家建立科技伦理委员会,完善科技伦理制度规范,加强科技伦理教育和研究,健全审查、评估、监管体系。2022年3月,中办、国办印发《关于加强科技伦理治理的意见》,确立了我国科技伦理治理的指导思想,要求健全科技伦理治理体制,强化科技伦理审查和监管要求,提出增进人类福祉、尊重生命权利、坚持公平公正、合理控制风险、保持公开透明等五项科技伦理原则。

第三阶段:各地方和行业结合自身发展实际推动科技伦理体系建设工作

自2022年12月起,黑龙江、湖南、四川、海南、福建等省份陆续出台一系列政策文件,加快建设科技伦理治理体系,规范所在省份的科技伦理审查工作;2022年10月,中国人民银行发布《金融领域科技伦理指引》,以指导金融领域从业机构开展科技伦理治理工作;2023年2月,国家卫健委等四部门联合发布了《涉及人的生命科学和医学研究伦理审查办法》,进一步明确了生命医学领域科技伦理审查的具体要求和规范流程。

二、《科技伦理审查办法(试行)》重点内容

当前,以人工智能大模型为代表的新兴技术应用不断涌现,脑机接口等前沿技术应用落地引发社会对科技伦理的广泛关注。为解决科技伦理审查职责不明确、程序不规范、机制不健全等问题,防范科技活动可能带来的潜在风险,推动科技创新与科技伦理的协同发展、良性互动,《审查办法》建立了一套覆盖全面、重点突出的科技伦理审查通用性规定,对科技伦理审查的基本程序、标准、条件等提出统一要求。

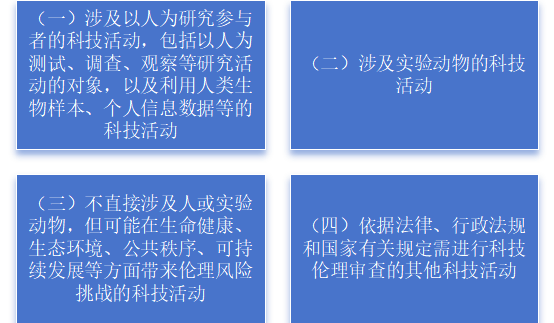

(一)明确适用伦理审查的“4+7”类科技活动

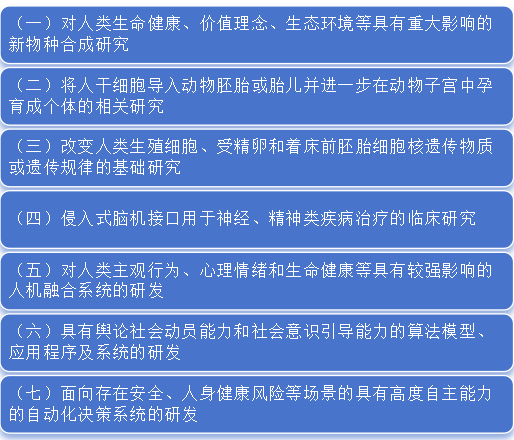

《审查办法》采用“一般列举(4项)+专家复核活动清单(7项)”的方式明确了需要进行科技伦理审查的活动范围,以及需要启动专家复核程序的高风险科技活动。

图1 需开展科技伦理审查的4类主要科技活动

大部分的科学研究和技术开发活动会被归为四类主要科技活动。例如,科技企业开展人工智能大模型技术研发且在模型训练过程中使用个人信息数据,则需按规定开展科技伦理审查工作。此外,专家复核清单还特别规定具有动员引导能力的“算法模型、应用程序及系统的研发”和人身健康风险场景下的“自动化决策系统的研发”需要开展科技伦理审查复核,这将使得通过互联网向一般公众开放的大模型应用以及在医疗、工业等领域应用的AI自主决策系统将需要开展科技伦理审查,并在申报单位通过科技伦理(审查)委员会的初步审查后,由该单位报请所在地方或相关行业主管部门组织开展专家复核。

图2 需进行专家复核的7类特定科技活动

(二)明确开展伦理审查的“4+7”类主体

高等学校、科研机构、医疗卫生机构、企业4类单位是开展科技伦理审查的责任主体,而科技伦理审查工作由单位的科技伦理(审查)委员会自主发起。《审查办法》要求,从事生命科学、医学、人工智能等科技活动的单位,研究内容涉及科技伦理敏感领域的,应设立科技伦理(审查)委员会;其他有科技伦理审查需求的单位可根据实际情况设立科技伦理(审查)委员会。值得注意的是,设立科技伦理(审查)委员会并开展科技伦理审查工作同时也是人工智能企业在算法备案程序中的一项评估内容。

此外,《审查办法》对科技伦理(审查)委员会的成员结构作出明确要求:委员会成员应不少于7人,设主任委员1人和副主任委员若干;委员会由具备相关科学技术背景的同行专家,伦理、法律等相应专业背景的专家组成,并应当有不同性别和非本单位的委员,民族自治地方应有熟悉当地情况的委员;委员任期不超过5年,可以连任。

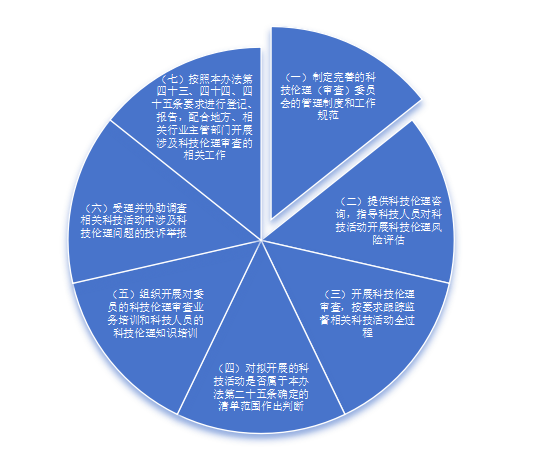

(三)明确实施伦理审查的“3X7”项要求

1.七项主要职责:《审查办法》规定科技伦理(审查)委员会至少包含以下7项主要职责:

图3 科技伦理(审查)委员会的主要职责

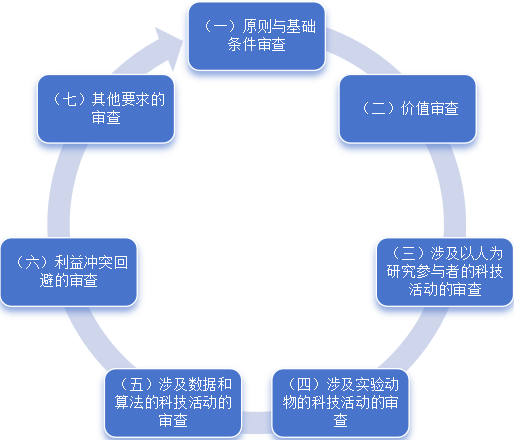

2.七项审查内容:《审查办法》要求科技伦理(审查)委员会主要从以下7个方向进行科技伦理审查:

图4 科技伦理(审查)委员会的审查内容

其中,人工智能大模型的研发通常会涉及数据和算法的科技活动,对此科技伦理审查将重点关注:数据的收集、存储、加工、使用等处理活动以及研究开发数据新技术等符合国家数据安全和个人信息保护等有关规定,数据安全风险监测及应急处理方案得当;算法、模型和系统的设计、实现、应用等遵守公平、公正、透明、可靠、可控等原则,符合国家有关要求,伦理风险评估审核和应急处置方案合理,用户权益保护措施全面得当。

3.七项审查流程:科技伦理审查程序有三种:简易程序、一般程序以及含有专家复核的特殊程序。简易程序的适用条件包括:科技活动伦理风险发生的可能性和程度不高于最低风险(指日常生活中遇到的常规风险或与健康体检相当的风险);对已批准科技活动方案作较小修改且不影响风险受益比;前期无重大调整的科技活动的跟踪审查。除适用简易程序以外的科技活动均适用于一般程序,而在专家复核活动清单中的可能产生较大伦理风险挑战的7类特定科技活动,还需在一般程序的基础上进行专家复核。

表1 一般审查程序的7项流程

三、企业开展科技伦理审查的建议

一是健全组织架构。人工智能、元宇宙等新兴技术企业应当审视自身技术研发活动是否属于科技伦理敏感领域,若在模型研发过程中涉及个人数据处理、自主决策系统等敏感行为要素的,应当设立科技伦理(审查)委员会,制定相应章程和制度,并按规定组织开展科技伦理风险评估。二是审慎开展高风险科技活动。科技企业应当对照“需要开展伦理审查复核的科技活动清单”,判断自身技术研发活动涉及人机融合系统、具有动员引导能力的算法模型、高风险场景的自动化决策系统,进而履行专家复核等更高的伦理审查义务,审慎开展相关研发活动。三是积极开展科技伦理研究工作。科技企业一方面应按规定建立科技伦理审查委员会,并通过在国家科技伦理管理信息登记平台进行登记,并每年定期上传科技伦理审查委员会工作报告等情况;另一方面,应前瞻研判新兴技术发展带来的规则冲突、社会风险、伦理挑战,积极参与制定本行业、本领域的科技伦理审查具体规范和指南,引导新兴技术产业“向上向善”发展。(文章作者:许智鑫)

声明:本文来自CIC 软件视界,版权归作者所有。文章内容仅代表作者独立观点,不代表安全内参立场,转载目的在于传递更多信息。如有侵权,请联系 anquanneican@163.com。